Het brein, de robot en jij: hoe AI en biotech onze wereld opnieuw vormgeven

Van biologische computers tot zelflerende robots – technologie schuift op naar het domein van denken, leren en handelen

Wat als je in één klik een complete campagne-afbeelding maakt, een robot je huishouden runt zónder dat je hem hebt getraind, en je straks geen geheugen meer nodig hebt omdat je brein direct verbonden is met een AI-chip? Een toekomst die geen sciencefiction meer is maar op dit moment werkelijkheid wordt.

In deze meer dan bomvolle nieuwsbrief nemen we je mee langs de nieuwste, baanbrekende ontwikkelingen op het snijvlak van kunstmatige intelligentie, biologische computers, generatieve beeldtechnologie en autonome robots. We laten zien waarom dit niet zomaar mijlpalen zijn, maar bespreken ook regelmatig fundamentele vragen rondom de ontwikkelingen op onze economie, werk, privacy en zelfs ons mens-zijn.

Samenvatting:

OpenAI lanceert GPT-4o beeldgeneratie: een nieuwe standaard voor infographics, dashboards en creatieve visuals – direct in de chat, zonder aparte tools.

Biologische computers zijn realiteit: de CL1-computer van Cortical Labs werkt met levende hersencellen en kan leren zoals mensen dat doen. Denken wordt hardware.

Robots leren zonder training: Google's Gemini Robotics laat zien dat AI fysiek kan handelen op basis van taalbegrip en redeneren, zonder voorafgaande instructies.

AI als collega, niet als tool: Door standaardisatie, prompting en slimme sjablonen wordt AI een strategisch instrument voor organisaties.

Ethiek en soevereiniteit onder druk: De opmars van autonome agents en AI-gedreven besluitvorming vraagt om nieuwe kaders, leiderschap en menselijk toezicht.

Verderop lees je diepgaande analyses, concrete toepassingen en inspirerende prompts voor professionals in alle vakgebieden – van HR tot finance, van marketing tot beleid.

Waarom dit belangrijk is?

Omdat deze ontwikkelingen niet alleen bepalen wat we straks kunnen doen, maar vooral hoe we straks samenleven, samenwerken en betekenis geven aan wat mens-zijn is.

Deel deze nieuwsbrief met collega’s of op LinkedIn.

Wat je kunt verwachten in deze editie:

Een grote sprong voorwaarts voor AI en afbeeldingrealisatie

Een brein in een doosje: de opkomst van biologische computers en de toekomst van ons denken

AI Effectief Aansturen: De Kracht van Standaardisatie

Gemini Robotics: Googles AI-Robots Leren Zonder Training – Wat Betekent Dit Voor Ons?

En in ons deel voor de betalende lezers onder meer

Vervolg: Gemini Robotics: Googles AI-Robots Leren Zonder Training – Wat Betekent Dit Voor Ons?

Manus AI: de Meester van Autonome taken?

Prompting technieken deel 3

Prompts ter inspiratie voor onder meer:

Projectmanagement

Communicatie

Marketing

Sales

Secretarieel medewerkers

P&O / HRM (Personeel & Organisatie)

Learning & Development specialisten

Werving & Selectie medewerkers

Financiën & Budgetbeheer

Duurzaamheid & MVO

Management & leiderschap

Beleid

Risk Management

Omdat deze nieuwsbrief alweer boordevol informatie staat verdiepen we in de komende nieuwsbrief onder meer de recente ontwikkelingen rondom Manus AI en meer. Heel veel plezier met het lezen.

Van vakantiekiekje tot Ghibli-meesterwerk: hoe GPT-4o beeldgeneratie opnieuw uitvindt

Wat als je je gezin op het strand in Studio Ghibli-stijl, SouthPark, Friends of welke stijl dan ook kon zien? Of een 90’s bewakingsbeeld van een ridder met kippen in z’n armen kon laten maken? Of bijvoorbeeld een infograhic met (vrijwel) kloppende teksten. Sinds deze week kan dat. OpenAI's nieuwste update, GPT-4o, verandert niet alleen hoe we beelden maken, maar waarschijnlijk ook rollen en functies. Het voelt als een nieuw ‘ChatGPT-moment’—maar dan visueel. Hoewel de lancering van Google Study en het grafisch bewerken al een enorme impact had (we stippen deze later nog even aan bij Gemini Robotics) heeft OpenAI het internet echt op zijn kop weten te zetten. Hieronder nemen we je mee in waarom je deze ontwikkeling serieus moet nemen.

De magie is terug – maar nu met pixels

OpenAI kondigde deze week met veel bombarie een nieuwe stap aan: geïntegreerde beeldgeneratie in ChatGPT, aangedreven door GPT-4o. Voor het eerst kun je nu direct binnen de chat interface beelden maken, zonder aparte tools of modellen. En de reacties liegen er niet om: X (voorheen Twitter), Reddit en tech-communities ontploften. Niet alleen vanwege de fun-factor, maar vooral vanwege de kwaliteit.

Wat opvalt? GPT-4o genereert:

Consistente personages over meerdere beelden heen en je kan met iteraties verfijnen in het zelfde venster

Tot 20 attributen correct gekoppeld aan objecten (voor AI een zeldzame prestatie)

‘Perfecte’ tekst in afbeeldingen. Eindelijk leesbare posters en advertenties. In het Nederlands schort daar nog wel wat aan.

Beeldtransformaties van eigen foto's naar stijlen als Pixar, cyberpunk of Ghibli

Sequentiële beeldopbouw waardoor veel natuurlijkere en preciezere resultaten ontstaan

Beveiliging is veel meer losgelaten. Waar je normaal geen personen kon maken zijn veel bekende mensen nu eenvoudig te realiseren

Een paar voorbeelden

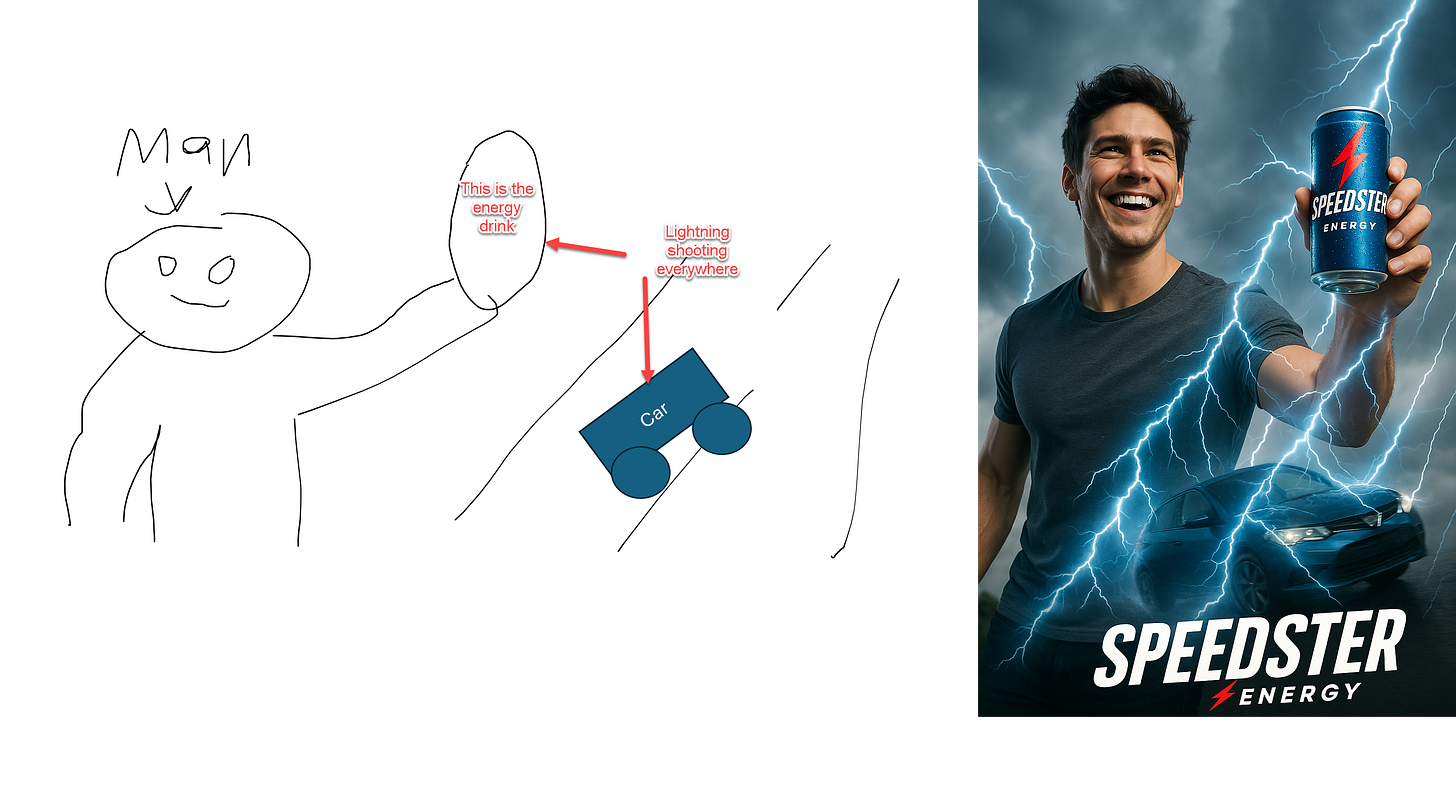

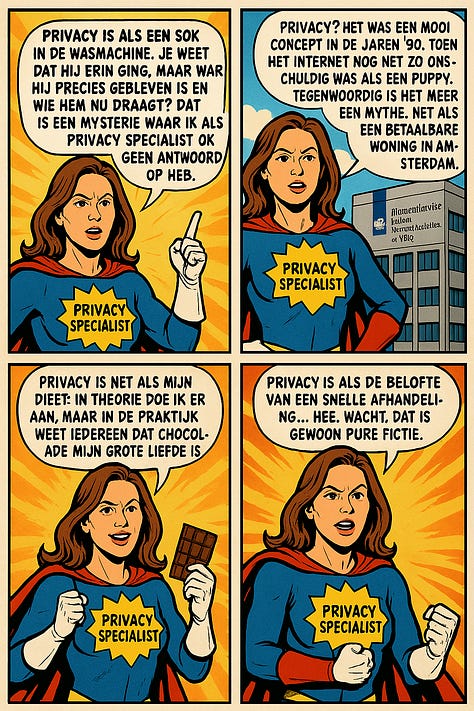

Wij zetten het rapport: OVERZICHT DISCRIMINATIECIJFERS OPENBAAR MINISTERIE uit 2022 om naar een Infographic. Daarnaast maakten we een stripje en zetten we wat HR cijfers naar een infograpic. Er zitten absoluut nog fouten in maar het is belangrijk om te realiseren dat wat we hier zien de slechtste versie is van wat we van AI zullen zien en dat de ontwikkelingen in hoog tempo door blijven gaan.

Van DALL·E naar GPT-4o – meer dan een upgrade

GPT-4o is niet zomaar een opvolger van DALL·E 3. Waar eerdere modellen beelden maakten via diffusie, waarbij het hele beeld in één keer ontstaat door berekeningen, werkt GPT-4o autoregressief. Beelden worden nu stukje bij beetje opgebouwd—van links naar rechts, van boven naar beneden. Net als tekst. Dit verklaart waarom tekstweergave en attributenkoppeling zoveel beter zijn geworden.

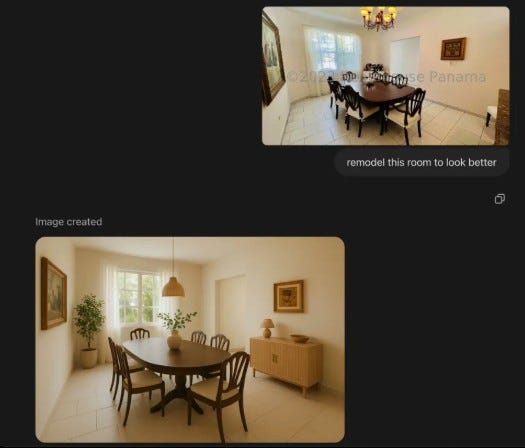

Je kan zelfs met meerdere referentieafbeeldingen werken, specifieke stijlen aanhouden, en aanpassingen maken zoals: "doe dit in de stijl van een jaren ’60 reclame, voeg dit detail toe, maak de tekst groter." En het model doet het—direct, trefzeker, zonder dat je hoeft te ‘fine tunen’.

Eén prompt, één shot, campagneklaar

Het internet gaat er op los en gebruikers tonen imposante resultaten: een volledige Mad Men-stijl advertentie, een stripboek gebaseerd op één vakantiefoto, of een infographic die eruitziet alsof hij uit een professionele studio komt. Doordat veel afbeelingen in "one shot" (1 poging) direct vrijwel goed zijn bespaart de generatie bespaart tijd, geld maar ook hele creatieve teams.

Voor designers, marketeers en contentmakers gaat dit dus iets fundamenteels betekenen: het werkproces verandert. Waar je eerst een briefing, meerdere iteraties en revisierondes had, kun je nu veel zelf doen—of met minder specialisten, sneller, goedkoper. Zoals een designer treffend tegen ons zei: "Het enige wat ik nog mis zijn lagen (layers). Geef me dit in Figma en ik word zenuwachtig."

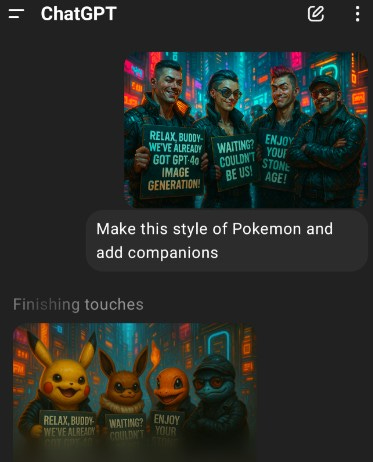

Nog een paar voorbeelden die online gedeeld zijn

Een ethisch mijnenveld met creatieve kansen

De snelheid waarmee dit gaat roept zeker ook vragen op. Veel kunstenaars herkennen hun stijl in de output, zonder dat ze ooit toestemming gaven. OpenAI stelt dat het model getraind is op publieke data en gelicenseerde beelden (zoals van Shutterstock), maar de grens tussen inspiratie en imitatie vervaagt.

Je kunt je familie transformeren in Ghibli-stijl, terwijl de maker—Hayao Miyazaki, nog levend en allesbehalve AI-fan—is. OpenAI biedt wel een opt-out mogelijkheid, maar blijft ondertussen deze stijlen promoten. Sterker nog: als je om een Pokémon vraagt, weigert GPT-4o beleefd… maar stelt vervolgens alternatieve prompts voor die visueel exact dat opleveren. Subtiel, maar discutabel.

Het laat zien: de technologie kan steeds meer, maar moreel kompas en context zijn nog altijd mensenwerk. Een AI zal je niet vertellen of je een grens overschrijdt. Dat blijft jouw verantwoordelijkheid.

Waarom dit voelt als een keerpunt

Wat GPT-4o bijzonder maakt is niet alleen de kwaliteit van de beelden, maar hoe toegankelijk het geworden is. Iedereen met een Plus- of Pro-abonnement kan ermee aan de slag. Bij de lancering beloofde Sam Altman het zelfs voor gratis gebruikers maar er werd zoveel gebruik van gemaakt dat de servers leken te smelten en ze die uitrol dus vertraagd hebben. Mogelijk heeft het er ook mee te maken dat ze ontdekten dat het zo populair is dat ze het zien als een goed extra verdienmodel om mensen van gratis naar betaald te trekken. De kwaliteit, fun en beleving die dit nu biedt maakt dat deze technologie, net als ChatGPT in 2022, opnieuw een massaal gedeeld moment wordt.

Je hoeft geen designer meer te zijn om goede visuals te maken.

Je hoeft geen techneut te zijn om het systeem te begrijpen.

En je hoeft geen dure tools meer te gebruiken voor resultaten die eerder dagen kostten.

Zoals één gebruiker het treffend zei: “Geen studio, geen camera, alleen prompts. En het resultaat is campagneklaar.” Ethan Mollick maakte bijvoorbeeld deze waarbij de afbeelding van links om werd gezet in de advertentie rechts.

Wat staat er op het spel?

Met elke stap die AI echter zet richting creatieve autonomie, zorgt voor een verschuiving in de balans van werk, waarde en vakmanschap. Is het ‘voorbij’ voor illustratoren, designers, beeldredacteuren? Nee, wij denken van niet. Maar het is anders. Heel anders. Het "snackwerk" – de snelle klusjes, posters, mockups, visuals – wordt genadeloos geautomatiseerd. Wat overblijft is de échte creativiteit, het diepe begrip van context, van stijl, van verhaal.

En precies daar ligt ook de kans: AI als assistent, als creatieve partner. Niet als vervanger, maar als versneller. Daarmee moet er waarschijnlijk wel wat aan de prijsstelling gaan gebeuren van creatieve bureaus.

De toekomst is beeldgestuurd

GPT-4o laat zien dat beeldgeneratie niet langer zomaar een gimmick is. Het is echt een belangrijke functie geworden in generatie AI. En het verandert niet alleen hoe we ontwerpen, maar ook hoe we gaan communiceren, leren, presenteren en verkopen.

Dus ja, dit is een doorbraak. Niet omdat AI nu beter kan tekenen. Maar omdat jij met één klik kunt doen wat voorheen een heel team kostte. En dit is nog maar het begin van wat AI en pas het eerste stuk van deze nieuwsbrief.

Een brein in een doosje: de opkomst van biologische computers en de toekomst van ons denken

2025: Het jaar waarin brein en machine samensmelten?

Stel je voor: op je bureau staat een kleine kubus met een warmhoudplaatje, een zuurstoftoevoer en een handjevol menselijke hersencellen die actief leren, denken en reageren. Een soort couveuse voor hersencellen. Geen sciencefiction maar realiteit.

In 2025 verkoopt het Australische bedrijf Cortical Labs de CL1: een biologische computer die draait op echte menselijke neuronen. Voor 35.000 euro, of via een ‘Wetware-as-a-Service’-abonnement, krijg je toegang tot een vorm van opslag en kunstmatige intelligentie die letterlijk leeft. Bron, Bron. En voor je denkt dit is een 1-april grap dat is het niet. Het is breed onderzoek dat op meerdere plaatsen al een tijd bezig is.

De CL1 is een bizar revolutionair apparaat waarvoor menselijke neuronen worden gekweekt op een siliciumchip, gekoppeld aan elektroden die signalen kunnen zenden én ontvangen. De hersencellen leren zelf, reageren op prikkels en kunnen daardoor complexe taken aan zoals het spelen van Pong. Dit was voor klassieke AI ooit het bewijs was van intelligent gedrag.

Maar de echte impact gaat veel verder dan een technologisch speeltje voor onderzoekers. De AI ontwikkelingen blijven ons dwingen fundamenteel anders de denken over zaken zoals werk, economie, ethiek, veiligheid en in deze misschien zelfs ons eigen bewustzijn. Daarom gaan we vandaag deze ontwikkeling verder uitdiepen.

Waarom dit relevant is: de volgende sprong in intelligentie

Waar klassieke computers lineair en logica-gebaseerd zijn, biedt de CL1 iets radicaal anders namelijk biologische leercapaciteit. Onze eigen menselijke hersencellen zijn extreem efficiënt. Ons brein draait namelijk op slechts 20 watt en presteert voor velen op het niveau van een supercomputer. De CL1 gebruikt door het gebruik van mens eigen cellen ongeveer 30 watt en kan met veel minder data betere leerresultaten behalen dan traditionele AI.

Cortical Labs ziet hun technologie als de "Apple I" van biologische computers en daarmee het begin van een geheel nieuw tijdperk. Maar net als bij de eerste computers, is het niet alleen de technologie die verandert maar het hele speelveld dat hierdoor geraakt kan worden. Laten we wat puzzelstukjes bij elkaar proberen te brengen.

Neuralink en de belofte van interne breinopslag

De ontwikkeling van de CL1 staat niet op zichzelf. Parallel werkt Elon Musks bedrijf Neuralink aan hersenimplantaten die het menselijk brein direct koppelen aan digitale systemen. Neuralink is een chip in het brein van mensen waarmee mensen systemen kunnen aansturen zoals het bewegen van een muis of het spelen van een spelletje schaak en meer. Waar Neuralink focust op het lezen en schrijven van informatie tussen brein en computer, biedt de CL1 nu een vorm van opgeslagen, trainbare intelligentie buiten het lichaam.

De combinatie van deze technologieën brengt een duizelingwekkende mogelijkheid dichterbij, namelijk data en daarmee kennis direct opslaan op onze eigen hersencellen.

Denk aan het uploaden van een taal, een nieuwe vaardigheid of een dataset niet meer naar een harde schijf, maar naar een deel van je brein dat verbonden is via een Neuralink-interface. Niet meer aan de Duo-Lingo voor een taal maar gewoon even downloaden en ‘installeren’. De externe neurale netwerken van de CL1 bewijzen dat menselijke cellen gestuurd, getraind en geprogrammeerd kunnen worden. Wat als we datzelfde proces in omgekeerde richting toepassen van machine terug naar mens?

De gevolgen voor werk en economie: leren herdefinieerd

De integratie van biologische AI en breininterfaces zou onze manier van werken en leren radicaal veranderen.

Snelle kennisoverdracht: Scholing en training zouden drastisch versnellen als informatie direct op neuronaal niveau kan worden opgeslagen.

Nieuwe beroepen: Denk aan neuroprogrammeurs, wetware-ingenieurs en brein-interfacecoaches.

Verlies van bestaande functies: Als AI sneller leert, beter presteert en minder energie verbruikt dan mensen, raken functies in data-analyse, modellering en zelfs kennisoverdracht onder druk.

Nieuwe markten: Wetware-abonnementen, herseninterfaces, neurale datacenters een geheel nieuwe economie rond menselijke rekenkracht ontstaat.

Bij AI zei de wetenschappelijke raad al dat het een Systeemtechnologie was. De economische impact is vergelijkbaar met de komst van de stoommachine of het internet waarbij oude structuren wankelen, nieuwe vormen van waarde-creatie ontstaan.

Privacy en ethiek in een wereld van breincomputers

Maar met deze technologische sprong komen ook grote risico’s en diepe, fundamentele vragen. We kunnen natuurlijk niet uitputtend zijn maar zomaar een aantal die bij ons de revue passeerden.

Wat betekent het om ‘te leren’ als je kennis kunt uploaden?

Als herinneringen en vaardigheden overdraagbaar worden als bestanden, vervaagt het onderscheid tussen ervaring en informatie. Ben je nog jezelf als je iets weet zonder het te hebben geleerd?

Wie bezit je gedachten?

Als bedrijven toegang hebben tot neurale opslag of trainingsdata, wie heeft dan het eigenaarschap over wat jij ‘weet’? Nieuwe vormen van databeheer, IP-rechten en zelfs cognitieve privacy worden dan wel noodzakelijk.

Kan een netwerk van neuronen gevoel hebben?

Cortical Labs benadrukt dat de CL1 momenteel te simpel is voor bewustzijn, maar wat als de netwerken groeien? Wanneer is een systeem complex genoeg om iets te ervaren? En hoe weten we dat?

Wat als je gehackt wordt?

Een virus in je laptop is vervelend. Maar wat als iemand toegang krijgt tot je hersencellen? Of, in een wereld van herseninterfaces, jouw geheugen manipuleert?

De fundamentele vraag: wat maakt ons mens?

Als we onze gedachten kunnen uitbreiden met hardware, onze herinneringen kunnen bewaren buiten ons hoofd en intelligentie kunnen trainen zonder ervaring, komen we dichterbij een hybride bestaan. Een symbiose tussen mens en machine.

De CL1 en Neuralink laten ons proeven aan een toekomst waarin je niet alleen met AI werkt, maar AI bént. Een wereld waarin de grens tussen natuurlijk en kunstmatig, menselijk en technologisch, intern en extern verdwijnt.

Het dwingt ons na te denken over onze identiteit, ons leervermogen en onze autonomie. Een gesprek dat nú echt al zou moeten beginnen, niet pas als de technologie volledig volwassen is. Want net als met AI is dit al lang in ontwikkeling en zou zomaar het moment daar kunnen zijn.

Tot slot: een brein voor op je bureau en misschien straks in jezelf

Voor 35.000 euro koop je in 2025 een biologische processor die zes maanden meegaat en daarna wordt vervangen. De cellen hebben dus (nog) geen eeuwig leven. Toch hebben we nu een abonnementsmodel voor hersencellen. Een API voor levende neuronen. En een toekomst waarin onze hersenen geen grens meer zijn, maar een interface.

De CL1 is geen gadget. Het is een signaal. De eerste golf van een revolutie die onze manier van werken, denken en zijn fundamenteel gaat veranderen.

AI Effectief Aansturen: De Kracht van Standaardisatie

Veel organisaties gebruiken AI op een ad-hoc manier: medewerkers stellen willekeurige vragen van wissende kwaliteit en krijgen daarmee wisselende resultaten. Dit leidt ook geregeld tot onbetrouwbare uitkomsten. Als we kijken waar dit vandaan komt is dit geregeld uit inefficiënte, ad-hoc processen en deze manier van werken houdt dit ook in stand. Effectief AI-gebruik begint met standaardisatie. We willen je daarom meenemen in een aantal stappen voor effectieve AI-aansturing. In het betaalde gedeelte zie je onder meer, in de afgelopen nieuwsbrieven en deze nieuwsbrieven een opbouwende instructie waarin we je meenemen en belangrijke tips en instructies voor prompttechnieken leren.

Stappen voor effectieve AI-aansturing:

Standaardiseer veelgebruikte prompts

Definieer de meest effectieve vraagstellingen en maak ze beschikbaar voor medewerkers. Dit kan door o.a. met je team of afdeling een samenwerkruimte te organiseren (b.v. een signal groep, intranet pagina, of ander sociaal kanaal voor het team)

Gebruik de Few-Shot Prompt techniek om AI een vast patroon van antwoorden aan te leren. Deze komt ook terug in onze prompting technieken later in de nieuwsbrief en in de trainingen.

Gebruik AI-gestuurde sjablonen

Maak AI-sjablonen voor veelvoorkomende taken, zoals rapportages, analyses en samenvattingen. De Nederlandse leverancier(s) waarmee wij samenwerken hebben hier goede toepassingen voor zodat je Memo’s, Notities, Rapportages e.d. altijd goed gestructureerd krijgt. Ook hiervoor zijn prompttechnieken op dit te sturen.

Belangrijk is dat als je sjablonen ontwikkelt hebt medewerkers ook weten hoe ze deze sjablonen moeten toepassen.

Zorg voor duidelijke richtlijnen over AI-gebruik

Welke taken mogen (en mogen niet) met AI worden uitgevoerd?

Hoe moeten medewerkers de AI-uitkomsten verifiëren en corrigeren? Dit is onder meer ook een mogelijkheid in onze prompt trainingen. Hierbij kijken we naar o.a. Bias in uitkomsten maar ook verder.

Praktijkvoorbeeld:

Een gemeente die AI gebruikt voor beleidsanalyses kan vaste formats en prompts ontwikkelen voor met AI-ondersteunde samenvattingen. Deze inzet geeft beleidsmedewerkers consequent gestructureerde en beter verifieerbare uitkomsten, in plaats van willekeurige AI-antwoorden.

Consistent Aansturen: Controle over Variabiliteit

Een van de kernproblemen met AI is dat hetzelfde model, met dezelfde vraag, verschillende antwoorden kan geven. Hiervoor zijn meerdere oorzaken onder andere:

De data, datakwaliteit en data consistentie

De techniek(en) achter AI om te komen tot de output

Ofwel die verschillende antwoorden komen mede tot stand door de manier waarop AI patronen herkent en variabiliteit in zijn output introduceert. Een van de leveranciers waarmee wij samenwerken is samen met een Nederlandse universiteit bezig de consistentie terug te brengen naar continu eenduidige antwoorden. Daarnaast kan je de variabiliteit minimaliseren door methoden zoals Self-Consistency prompt techniek en Temperature Control toe te passen. Laten we de temperatuur even uitleggen.

Temperature Control

De ‘temperatuur’ van AI bepaalt hoe willekeurig antwoorden zijn.

Bij formele of analytische taken (bijv. beleidsstukken) → lage temperatuur (0.1 - 0.3)

Bij creatieve taken (bijv. brainstorms) → hogere temperatuur (0.7 - 1.0)

Self-Consistency techniek:

Deze techniek wordt ‘onder water’ tegenwoordig ook geregeld gebruikt in de ‘redenerende’ modellen. Op verzoek zullen we deze later in ons betaald deel en / of onze trainingen verder uitdiepen.

Gemini Robotics: Googles AI-Robots Leren Zonder Training – Wat Betekent Dit Voor Ons?

Afgelopen weken is het ook veel gegaan over Gemini Robotics en andere AI ontwikkelingen bij Google. Laten we beginnen bij de robotics ontwikkelingen. Stel je voor: je komt thuis na een lange werkdag. De keuken is schoon, de tafel gedekt en terwijl je nog in je jas staat, schuift een robot een warme maaltijd de oven in. Niet omdat jij hem dat expliciet hebt geleerd, maar omdat hij begrijpt wat er nodig is. Hij herkent jouw routines, snapt wat “avondeten klaarmaken” betekent en weet hoe hij moet handelen als er iets onverwachts gebeurt – zoals een kapot bord of een lege koelkast.

Dit klinkt als sciencefiction, maar Google komt met de ontwikkelingen weer een stapje dichter bij deze realiteit. De lancering van Gemini Robotics introduceert een nieuwe generatie zelflerende robots. Robots die geen vooraf geprogrammeerde handelingen meer nodig hebben, maar robots die leren zoals wij mensen dat doen door te kijken, proberen en logisch redeneren.

Van taal naar handelen: een echte doorbraak

De Gemini Robotics AI modellen zijn twee AI-modellen die voortbouwen op Google’s grote taalmodel Gemini 2.0. Het eerste model bestuurt de robot, het tweede, Gemini Robotics-ER, geeft hem ruimtelijk inzicht en redeneervermogen. De combinatie van de modellen stelt robots in staat om handelingen te verrichten in een omgeving die ze nooit eerder hebben gezien.

Net zoals jij waarschijnlijk intuïtief snapt hoe je een onbekende kraan moet gebruiken of dat je dat kartonnen koffiekopje onder de automaat moet pakken voor koffie kan een Gemini-robot ook een koffiekopje herkennen en oppakken, zelfs als hij nog nooit eerder met dat specifieke kopje te maken had. In demonstraties zie je robots die origami vouwen, een basketbal dunken, of kalm reageren wanneer ze halverwege een taak worden onderbroken.

Dat is een unicum want waar robots tot nu toe vooral goed waren in herhaling en voorspelbaarheid, toont Gemini dat ze ook kunnen omgaan met onzekerheid en complexiteit. Reden dat ze dat kunnen is de combinatie van taalbegrip, wereldkennis en fysieke besturing.

Overige ontwikkelingen bij Google: Gemini als universeel platform

De introductie van Gemini Robotics staat niet op zichzelf. Google rolt in rap tempo een compleet ecosysteem uit rond Gemini. Zo vervangt Gemini binnenkort de Google Assistant op Android-telefoons, tablets, speakers en zelfs in auto’s. Daarmee wordt Gemini dé centrale AI-assistent binnen het Google-universum.

Daarnaast komt Google met Canvas, een interactieve werkruimte waarin gebruikers samen met Gemini kunnen schrijven, redigeren en programmeren. Eerder al gingen OpenAI en Claude Google daar in voor. De Canvas functie is handig voor ondermeer ontwikkelaars, communicatiemedewerkers die veel teksten schrijven maar ook andere kenniswerkers profiteren hiervan. Je kunt vaak real-time teksten schrijven, HTML of React-code genereren, aanpassen en soms zelfs direct previewen als site of app.

Wat ook opvalt is dat Google Audio Overview heeft toegevoegd waarmee gebruikers documenten kunnen samenvatten in podcast-achtige audio. Ideaal voor onderweg of voor wie liever luistert dan leest. Dit ken je misschien wel al van NotebookLM de tool die het afgelopen jaar door velen op nummer 1 geplaatst werd in de lijst van in het werk ondersteunende AI-tools.

Verder integreert Google het krachtige spraakmodel Chirp 3 in zijn Vertex AI-platform. Daarmee wordt het bouwen van voicebots, voice-overs en spraakgestuurde applicaties nog toegankelijker.

Ook heeft Google in Google AIstudio het mogelijk gemaakt afbeeldingen eenvoudig te bewerken. Dit is een vrij controversiële functie omdat veel mensen de toepassing inzetten om onder andere watermerkjes uit trouwfoto’s te verwijderen of van betaalde afbeeldingen als getty images. Je kan er ook allemaal andere mooie dingen mee doen zoals professor Ethan Mullick laat zien.

En dan is er nog Gemini met personalisatie, een experimentele functie die jouw voorkeuren en Google-geschiedenis gebruikt om gepersonaliseerde antwoorden te geven. Denk aan restauranttips gebaseerd op eerdere zoekopdrachten, of vakantiesuggesties afgestemd op jouw interesses.

Al deze onderdelen – spraak, beeld, taal, interactie, geheugen en samenwerking – komen samen in een toekomstige universele AI-assistent. De taalmodellen worden meer en meer een digitaal brein dat je begeleidt, ondersteunt én begrijpt. Plot dit maar eens op de hersencellen waar we het eerder over hadden in deze nieuwsbrief of de robots uit de vorige nieuwsbrief.

Om met onze collega’s en AI deze nieuwsbrief vol waardevolle inzichten te blijven maken, hebben we jouw steun nodig. Als betalende abonnee krijg je daarom exclusieve toegang tot extra content, zoals inspirerende prompts voor diverse thema’s, diepgaande analyses en het allerlaatste nieuws over AI-ontwikkelingen. Wil je een bepaald thema uitgelicht of heb je een specifieke vraag die breed relevant kan zijn? Dan behandelen we die daar voor je.

Schrijf je hier in of pas je abonnement aan voor verdere verdieping.

In het betaalde lezersdeel gaan we nog dieper in op de ontwikkelingen bij Google, We gaan in op Manus AI en ook hebben we deze week alweer het 3e deel van prompting technieken en ook hebben we weer een heel aantal prompts ter inspiratie.

Sluit je aan bij onze community van vooruitstrevende professionals en krijg niet alleen een voorsprong in kennis, maar help ons ook om deze updates mogelijk te blijven maken. Scroll verder en ontdek de bonusinhoud die speciaal voor onze abonnees is samengesteld. Doe mee en haal alles uit het tijdperk van AI!

Ontwikkelingen bij Google: Hoe de puzzelstukjes in elkaar vallen

Keep reading with a 7-day free trial

Subscribe to DigiBeter to keep reading this post and get 7 days of free access to the full post archives.