Prompt Engineering: de sleutel tot AI succes (vervolg 1)

Ontdek de kunst van effectieve AI Interactie

Prompt Engineering is in het afgelopen jaar een belangrijke vaardigheid geworden. Goede instructies aan een Generatieve AI kunnen geven is een kunst en wel zo’n kunst dat er soms behoorlijke salarissen geboden worden voor iets dat in de basis eigenlijk meevalt. Daarom nu het vervolg op de 1e nieuwsbrief over prompten.

DigiBeter geeft trainingen voor Overheid, Semi-Overheid en organisaties in de basis van AI maar ook in Prompt Engineering. Een mooi vervolg op de basiskennis. We doen dit omdat we zien dat AI impact heeft op iedereen. In de voorgaande post zijn we ingegaan op terminologie, wat prompt engineering is en we hebben een eerste basis gelegd want met een beetje handigheid kom je al een heel eind. Hoewel Trainingen je helpen de basis te verstevigen kan je op veel gebieden ook ver komen door zelf aan de slag te gaan.

In deze nieuwsbrief daarom deel 2 van de basisgids over hoe je prompts op kan stellen. En omdat modellen veranderen en in de basis anders kunnen functioneren zullen we naar verwachting in de toekomst hier vaker aandacht aan besteden. Doel van de basisgids is om je aan het denken te zetten en een deel van de basisprincipes van prompt engineering inzichtelijk te maken zodat je dat in je voordeel kan benutten. We kunnen lang niet alles uit kunnen diepen dus wil je meer leren neem dan contact met ons op om een stevig fundament te leggen en natuurlijk voor verdiepende trainingen.

Met vaardigheden in prompt engineering kun je spannende carrièremogelijkheden openen of je huidige rol verbeteren. Maar belangrijker nog je bent klaar voor een nieuwe werkelijkheid waarin je zodanig samen kan werken met de AI dat je er zoveel mogelijk uit haalt.

Inhoudsopgave

Basis Terminologie - deze loopt over de hoofdstukken heen -

Enkele parameters

Model

Tokens

Temperatuur

Lengte

Top-P

Enkele vormen van prompts toegelicht

Rol (Persona) prompting

Omgekeerd interactie prompten

Instructiepatroon prompting

Denk/ redenatie prompting

Beoordelingsprompting

Excel, Powperpoint prompting

en vele andere vromen

Mega prompting

Hulp prompts

1. Enkele parameters

Vorige keer gingen we in op enkele prompt en toen gaven we aan dat in prompts ook bepaalde parameters interessant kunnen zijn om mee te geven. Deze parameters zijn van invloed op jouw prompts en daarmee ook op de resultaten.

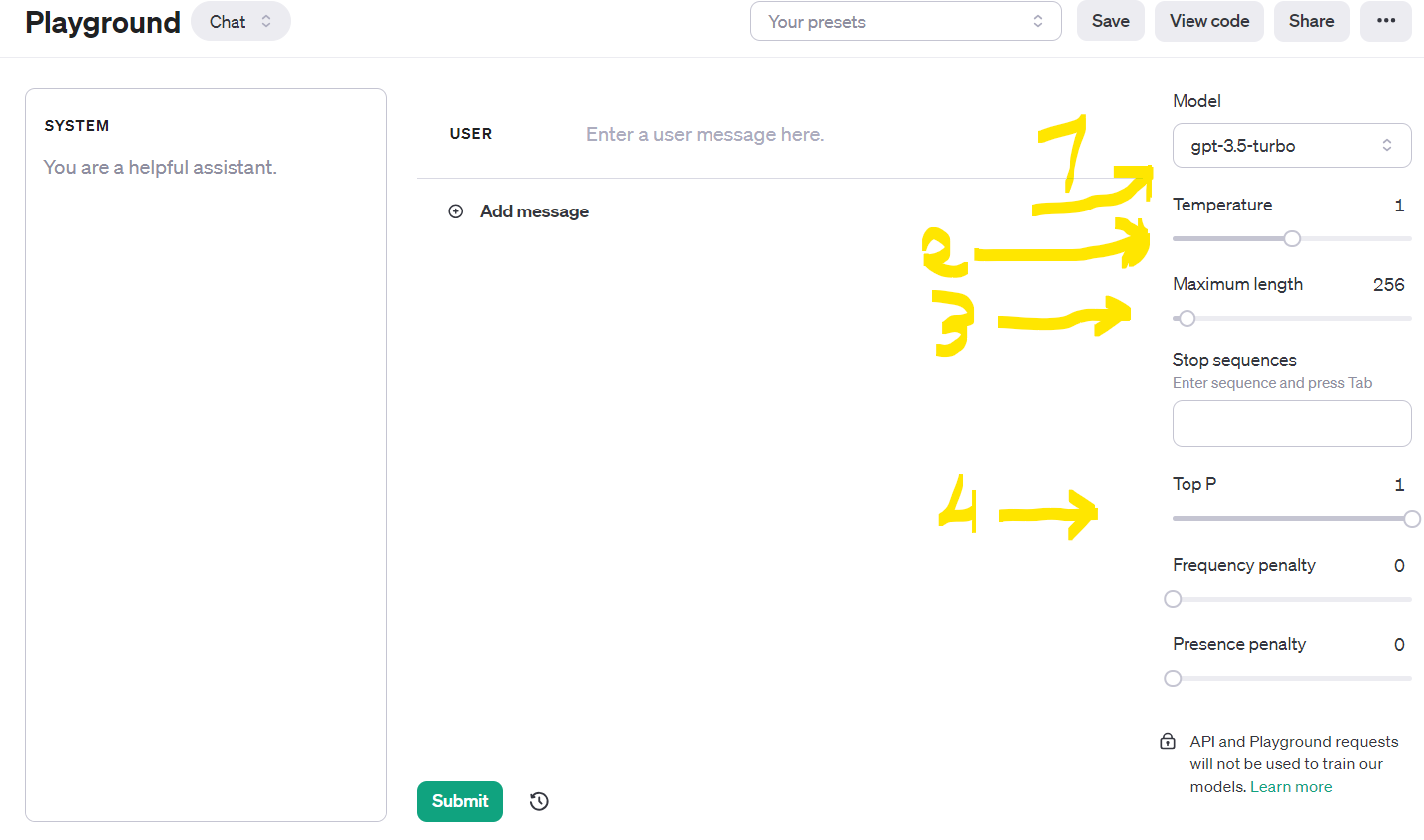

We kunnen die parameters het beste uitleggen door te kijken naar de OpenAI Playground. Dit is de ‘achterkant’ van ChatGPT die velen nog niet veel gezien zullen hebben. Op deze ‘achterkant’ zie je een aantal zaken.

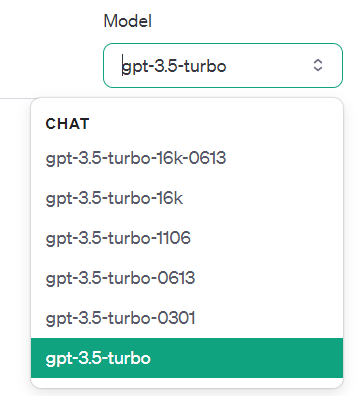

Laten we beginnen bij 1. Het Model. Wanneer je een systeem getraind hebt om iets te doen dan krijg je een model. Wat je daar ziet is dus het model. Hier hebben we dus het GPT 3.5-turbo Large Language Model. Maar er zijn er meerdere de je daar voor chat kan selecteren. Een aantal daarvan zie je in de afbeelding hieronder.

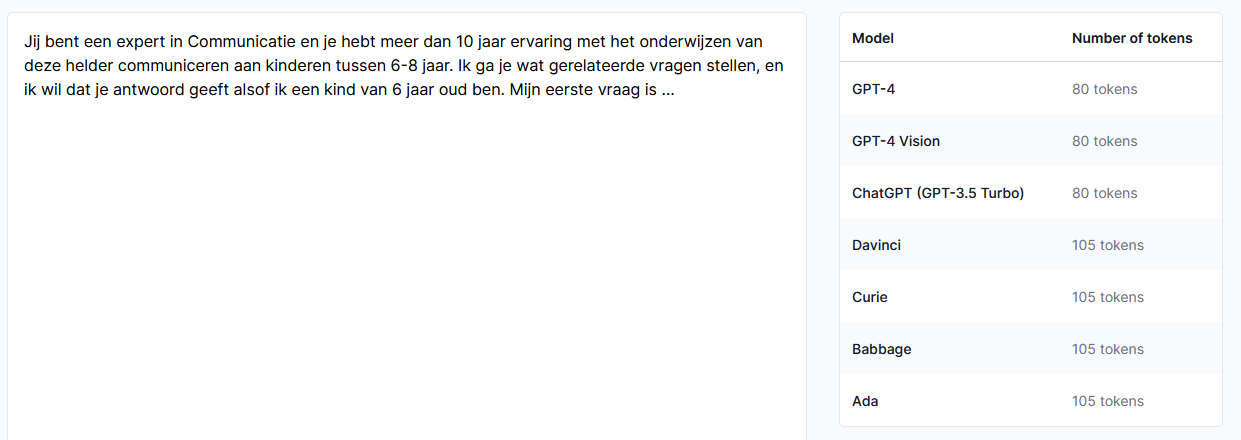

Elk model heeft bepaalde grenzen en mogelijkheden zoals een bepaald aantal Tokens dat het aan kan. Wat is een Token? horen we we vragen. Het Large Language Model zal jouw prompt Tokenizen. Dit betekent dat het jouw invoer in tokens opsplitst tot een klein stukje informatie dat een bepaalde waarde of betekenis vertegenwoordigt dat gebruikt wordt om de tekst die het taalmodel moet verwerken in kleine brokjes te verdelen. Tokens kunnen op meerdere manieren gedefineerd worden maar vaak is een token vaak een woord of deel van een woord, cijfer, punt, komma of andere reeks tekens met een eigen aparte betekenis. We gaan hier nu niet verder op in dat doen we in de trainingen maar het is goed om te onthouden dat het dus tekst opbreekt.

Dat opbreken doet het model zowel voor de input als de output en bij veel modellen betaal je per token en zijn er dus maxima aan de hoeveelheid tokens die ze kunnen verwerken als input en kunnen leveren als output. Hier onder zie je een voorbeeld van het aantal tokens voor een eenvoudige prompt gekoppeld aan een aantal modellen.

Stel nu dat je een heel boek met ChatGPT wilt maken betekent dat wanneer je model 4000 tokens bevat je dus meerdere prompts nodig hebt omdat een boek meer dan 4000 tokens bevat.

2. De temperatuur. Dit is niet hoe warm of koud je iets bereid maar de temperatuur van het antwoord. De temperatuur wordt gebruikt om het niveau van willekeur en creativiteit in de gegenereerde tekst te controleren. In veel modellen (o.a. ChatGPT en Google Bard) is het zo dat hoe hoger te temperatuur, hoe creatiever het antwoord. Hoe lager de temperatuur hoe minder creatief en mogelijk herhalend het antwoord zal worden. Dit is niet slecht overigens want je forceert het model op die manier dichter bij de input van de prompt en vaak ook vaak om dichter bij de trainingsdata te blijven. De temperatuur wordt meestal gedefinieerd als een getal tussen de 0 en de 1.

Stel dat je vraagt in je prompt om een verhaal voer een kat te schrijven met een temperatuur van 0 zal het verhaal mogelijk gaan over een kat die in een huis woont, speelt met speelgoed en eten krijgt van zijn baasjes. Een temperatuur van 1 zal waarschijnlijk resulteren in een veel creatiever verhaal zoals over een kat die de wereld over reist, vriendjes met een hond wordt en misschien wel superkrachten heeft.

Afhankelijk van het model kan je dat ook aangeven in de prompt door bijvoorbeeld te zeggen: “Schrijf een verhaal over een kat met een temperatuur van 0,3” of door bijvoorbeeld parameters specifiek in je prompt te benoemen zoals: “Temperatuur = 0,7”. Of in de Open AI Playground kan je dit op de ‘achterkant’ met een schuif inregelen.

Als je gaat prompten als Prompt engineer zal je dit dus moeten uitproberen en kijken welke temperatuur het gewenste antwoord oplevert.

3. De maximum lengte.

Zoals gezegd hangt de maximum lengte af van het aantal tokens maar er zijn redenen waarom je, ondanks dat de maximum lengte misschien groter is, je toch het aantal tokens zal willen beperken. Een van die redenen is dat het verwerken van een langere prompt meer tijd in beslag neemt, meer energie verbruikt en je doorgaans betaald per token en het dus ook duurder is. Een andere belangrijke reden is, is dat langere prompts kunnen leiden tot ongewenste uitvoer. Waarom dat exact is leggen we ook uit in onze trainingen.

Om je prompts kort te houden is het aan te raden korte zinnen en woorden te gebruiken, in je prompt beperkingen op te leggen aan de lengte en overbodige en dubbele informatie zoveel mogelijk te vermijden.

4 .Top P. Dit staat voor Top percentage. Een methode die ook net als de temperatuur bijdraagt aan het sturen van de mate van willekeurigheid van Large Language Modellen. De methode kiest uit de meest waarschijnlijke woorden waarvan de opgetelde waarschijnlijkheid een bepaalde drempel overschrijdt.

Door dit te doen helpt Top-p dus het beste woord te kiezen door te kijken naar alleen de meest waarschijnlijke keuzes. Dus weer terug naar ons verhaal over de kat. Als de Top-p waarde 1 is, dan zal het het taalmodel elke mogelijke volgende lettergreep genereren ongeacht of de lettergreep relevant is voor de prompt of niet. Dat kan daarmee leiden tot ongewenste uitvoer zoals een verhaal dat over een kat gaat of vol fouten zit. Het voordeel is dat het zal leiden tot meer creatieve en onvoorspelbare uitvoer waarmee je ook, bijvoorbeeld in het geval van brainstorms, dus veel meer out-of-the-box komt dan als je hem meer beperkt.

Gaan we nu voor een top-p waarde van 0,5 dan pakt het al meer logisch dicht bij de prompt te blijven. Er zitten dan nog wel creatieve elementen in. Ga je meer richting de 0,2 dan zal je waarschijnlijk een beknopter en meer informatief antwoord krijgen op je vraag. Ook hier kan de setting verschillen per model net als de manier waarop je de Top-P waarde in je prompt ingeeft.

2. Enkele vormen van prompts toegelicht

In de DigiBeter trainingen leren we na de basistraining onder andere over de vele verschillende manieren van het geven van instructies aan een Large Language Model. Hoewel het voor elk model - bv Google Gemeni, CoPilot, Chat GPT of andere- niet iets anders kan werken zitten er in de basis veel overeenkomsten.

In trainingen kijken we hoe we dagelijkse uitdagingen kunnen koppelen aan de diverse manieren van prompting maar dat is hier te complex. We lichten er daarom een aantal van de vormen van prompting uit (er zijn er meer) en geven daar een korte toelichting bij die we in de trainingen verder uitdiepen.

a. Rol (persona) prompting

De persona prompt is een instructie om een taalmodel zich zo te laten gedragen dat het zich voordoet als specifieke ‘persoon’. Dit kan je inzetten om bijvoorbeeld meer informatie kwijt te kunnen in één enkele instructie wat weer ruimte biedt (gezien o.a. limitaties in tokens) voor andere relevante instructies en context.

Eenvoudig voorbeeld:

Gedraag je als een arts assistent. Je doet de eerste uitvragen en indicaties van patiënten voordat ze bij de huisarts binnenkomen. De patiënt komt voor een algemeen consult. Doe, stap voor stap, een gedetailleerde en grondige uitvraag gebaseerd op de hieronder geformuleerde uitvraagvelden. Zorg ervoor dat je relevante vragen stelt om een volledig beeld de krijgen van de gezondheidstoestand van de patiënt, en overweeg mogelijke rode vlaggen of urgente kwesties. Doel is om de huisarts voldoende informatie te verstrekken voor een effectieve en efficiënte behandeling tijdens het consult. De informatievelden zijn: Symptomen/huidige klachten van de patiënt:

Medische voorgeschiedenis van de patiënt:

Huidige symptomen:

Medicijnen die de patiënt momenteel gebruikt:

Allergieën van de patiënt:

Recent medisch onderzoek/behandelingen:

Familiale medische geschiedenis:

Sociale levensstijlfactoren (bv. roken, alcoholgebruik, lichaamsbeweging):

Eventuele psychosociale stressfactoren:

Specifieke vragen die relevant zijn voor het bezoek aan de huisarts:

Nu is dit een prompt die leuke, interessante uitkomsten kan geven. Helaas kan je ChatGPT niet echt zo inzetten omdat je hier dan bijzondere persoonsgegevens gaat verwerken en dat mag niet in dergelijke openbare systemen.

Persona prompts kan je op vele diverse manieren inzetten en dat levert veel kansen. Je zou dit bijvoorbeeld ook om kunnen draaien en het model zich voor laten doen als een Patiënt. Op die manier zou je bijvoorbeeld als arts in training kunnen oefenen met diverse scenario’s om te zien of je tot de juiste diagnose komt.

Nu kunnen we ons voorstellen dat je de persona prompt voornamelijk inzet voor jour rol of functie. In Chat GPT heb je een mogelijkheid om (links onderin waar je gebruikersinformatie staat) Custom instructions in te voeren. Deze kunnen je helpen om informatie meer af te stemmen op de door jou gewenste input.

Belangrijk is wel dat je daar echt heel goed let op wat je ingeeft. Zorg bijvoorbeeld dat het niet te herleiden is naar jouw werkgever want daarmee kunnen door jou ingegeven acties & informatie verbonden worden aan je werkgever. Let op dat je er geen privacy gevoelige informatie over jezelf achter laat. En nog veel meer. We willen je dus vooral meegeven zeer goed na te denken over wat je daar achter laat zodat de informatie veiligheid en privacy regels vanuit wetgeving en organisatiebeleid niet geschonden worden.

b. Omgekeerd interactie prompten

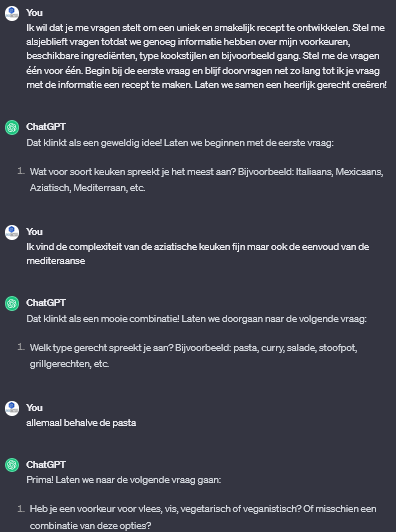

Dit sluit een beetje aan bij de voorgaande uitleg waarbij we over spraken bij het omdraaien van de arts en patiënt rol. Deze vorm van prompting keert alleen de rol niet om maar het patroon. Normaal vraag je modellen iets en krijg je daarop een antwoord. Deze vorm van prompten zorgt ervoor dat het model vragen gaat stellen waarop jij over het antwoord na moet gaan denken. Een mogelijke reden om dat te doen is om bijvoorbeeld diepgaande informatie te verzamelen op basis van vragen waar je zelf misschien nog niet eens aan gedacht had.

Eenvoudig voorbeeld:

Ik wil dat je me vragen stelt om een uniek en smakelijk recept te ontwikkelen. Stel me alsjeblieft vragen totdat we genoeg informatie hebben over mijn voorkeuren, beschikbare ingrediënten, type kookstijlen en bijvoorbeeld gang. Stel me de vragen één voor één. Begin bij de eerste vraag en blijf doorvragen net zo lang tot ik je vraag met de informatie een recept te maken. Laten we samen een heerlijk gerecht creëren!

Op deze manier kan je interessante gesprekken uitlokken en onder meer komen tot bijzondere nieuwe ideeën.

C. Denk / redenatie prompting

Een van de grote uitdagingen van de modellen (op dit moment nog) is dat ze niet zo logisch kunnen redeneren als wij. Als wij complexe uitdagingen hebben zijn velen van ons in staat een uitdaging op te delen in dusdanige brokjes dat we stap voor stap de uitdaging af kunnen pellen. Nadat we alle laagjes opgelost hebben pakken we ze samen en hebben we onze uitdaging opgelost.

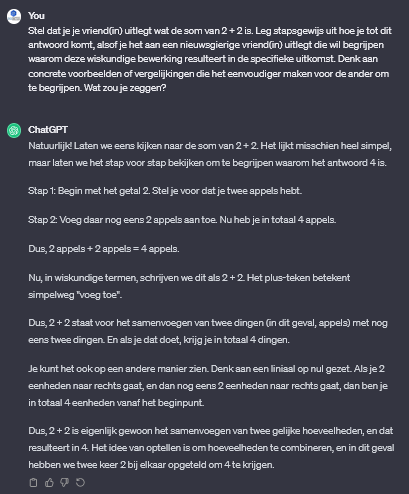

Denk / redenatie prompting helpt het model hetzelfde te doen als wij in gevallen die te complex zijn om in één keer op te lossen. Zo kan het model bijvoorbeeld uitleggen vanuit welke logica een bepaald antwoord tot stand gekomen is. Nu willen we het voor hier eenvoudig houden dus simpel gezegd als we zouden vragen aan een taalmodel: Wat is 2 + 2 dan is het antwoord taalmodel: 4. Dit is een antwoord dat we natuurlijk allemaal snel kunnen berekenen en beredeneren maar als het complexer is wordt dat al snel lastiger. Zowel in de basistraining als in het vervolg zit prompting volgens het denkpatroon prompt. Die in de basis gaat al ver maar in de prompttraining maakt het next level. Voor dit voorbeeld zouden we kunnen gaan voor een eenvoudige prompt maar toch interessante vraag.

Eenvoudig voorbeeld:

Stel dat je je vriend(in) uitlegt wat de som van 2 + 2 is. Leg stapsgewijs uit hoe je tot dit antwoord komt, alsof je het aan een nieuwsgierige vriend(in) uitlegt die wil begrijpen waarom deze wiskundige bewerking resulteert in de specifieke uitkomst. Denk aan concrete voorbeelden of vergelijkingen die het eenvoudiger maken voor de ander om te begrijpen. Wat zou je zeggen?

Hoewel er discussie mogelijk is over de kwaliteit van het antwoord, zal het voor de meesten onder ons duidelijk zijn hoe het antwoord tot stand gekomen is. Net als met andere vormen van prompting zijn er diverse redenen en manieren om een denkpatroon prompt op te bouwen om je te helpen bij je werkzaamheden. Gezien beperkingen van lengte van de nieuwsbrief onthouden we ons van die diepte. Meer methoden om dit te bereiken zoals bijvoorbeeld middels Few Shots leer je in een van de vervolgen op de basistraining naamelijk de Deep Dive met Prompt training. Maar je als je nu een goede methode hebt mag je die uiteraard ook achter laten in de comments.

D. Beoordelingsprompting

We hebben vele taalmodellen, de online taalmodellen zijn al bijzonder goed getraind maar om bijvoorbeeld de eerder genoemde privacy redenen gaat toch geregeld ook de voorkeur er naar uit om een eigen model te realiseren en te trainen. Maar een van de mogelijkheden van het beoordelingsprompt is om je te helpen dit te versnellen.

Het beoordelingsprompt is een benadering waarbij je een taalmodel gebruikt om de output van een ander taalmodel te evalueren. Je kan dit bijvoorbeeld inzetten om je prompts te testen om te zien of die nog effectief zijn wanneer het door jou gebruikte taalmodel een grote update heeft gehad van de input gegevens of anderszins.

E. Prompting voor MS PowerPoint of MS Excel

Wanneer je CoPilot van Microsoft gebruikt heb je deze prompts niet meer nodig. Maar als dit de enige reden is om meer dan 20 euro per maand te betalen voor CoPilot kan je beter gebruik maken van de gratis versie van CoPilot, ChatGPT of Google Bard.

Deze modellen zijn namelijk uitstekend in staat je te helpen om Visual Basic of Macro code te schrijven. Die code kan je vervolgens, zoals -zo meenden wij ons te herinneren - in de afgelopen nieuwsbrief al omschreven in de applicatie plakken.

We hadden enkele vragen gekregen waarom dat thuis en op werk soms niet lukt. Na contact lijkt een van de redenen dat je wellicht de optie “Ontwikkelaars” nog niet hebt. Daarvoor moet je wel eerst onder bestand → opties → lint aanpassen → ontwikkelaars aanvinken (blok rechts) → en op OK klikken. In je lint zie je dan de optie ontwikkelaars tevoorschijn komen en daar zit Visual Basic onder.

Als je die hebt kan je aan de slag met de door jou gegenereerde code om zo te komen tot een mooie Powerpoint of bepaalde Excel functionaliteiten.

F. En vele anderen

Naast de hierboven genoemde prompts zijn er nog vele anderen

Vele anderen zoals

Instructiepatroon prompt. Een manier om je taalmodel met voorbeelden te trainen om zo meer accurate en relevante output te realiseren.

Uitbreidingen op het instructiepatroon prompt. Een uitbreiding op het instructiepatroon prompt waarmee je het model niet alleen traint op input en output maar ook de mogelijk daar tussen liggende stappen.

Verkorte notatie prompts. Een handige manier om gestructureerd en gestandaardiseerd en daarmee efficiënt met een model te werken.

Recept prompting. Nee geen recepten voor kookboeken maar een manier om te komen tot nog ontbrekende stappen in een oplossing.

En zo zijn er nog een aantal die je, wanneer je ze eenmaal door hebt, heel mooi toe kan passen op situaties binnen jouw werk of natuurlijk thuis. In de Trainingen kijken we, zonder dat we met bedrijfsinformatie of privacy informatie aan de slag gaan, naar situaties die mogelijk relevant zijn voor jouw werk. Op die manier denken we case gebaseerd na over de inzetbaarheid van AI binnen de organisatie. Dit helpt om te komen tot toepassingen in het dagelijks werk waarna je, in samen werking met onder meer je eigen IT organisatie(s), kan kijken hoe de toepassingen ook in het dagelijks werk geïntegreerd kunnen worden.

Meer weten over onze trainingen? Stuur ons een mail of neem contact op via de DigiBeter LinkedIn pagina. Alle contactgegevens vind je hier: DigiBeter

3. Mega Prompting

Een prompt kan door een combinatie van diverse type patronen (prompts) heel uitgebreid worden. Zo’n uitgebreide prompt wordt ook wel een mega prompt genoemd. Mega Prompts volgen een formule om te komen tot het beste resultaat.

Als je nu weet welke typen prompts er zijn en hoe ze werken dan kan je dat samen met de formule combineren en optimaal toepassen in het opbouwen van zo’n mega prompt.

Een voorbeeld van een formule voor Mega prompt is de ‘C.R.E.A.T.E.’ formule. Dit ezelsbruggetje helpt je een aantal typen prompts te combineren tot één voor het LLM goed volgbare prompt.

De C staat voor Character ofwel de persona.

En de C is het eerste deel van deze megaprompt formule. Doel is te vertellen welke rol je wilt dat het Large Language Model aanneemt en welke motivatie het model heeft. Bijvoorbeeld: “Je bent een zeer getalenteerde journalist met 25 jaar ervaring in het maken van hoog gewaardeerde nieuwsartikelen”.

R staat voor Request ofwel jouw verzoek. Je vertelt hier wat je wilt dat het Taalmodel voor je doet. We raden je hier aan specifiek te zijn. Dus niet alleen “schrijf voor mij een artikel over een sportwagen”

maar “Schrijf voor mij een overtuigend artikel voor de Ascari KZ1. Dit is een sportwagen waarvan slechts 50 stuks gemaakt werden. De wagen is voorzien van een 507 PK sterke V8 uit de BMW M5 en kopers kregen bij de aankoop een racecursus aangeboden. Het artikel moet lezers vertellen dat ze deze auto echt zelf moeten ervaren en ontdekken hoe het voelt om aan je stoel gekluisterd te zitten, de hartverscheurende opwinding van het nemen van bochten te voelen en te genieten van de ervaring van iedereen die kijkt om te zien wie er in de bestuurdersstoel van de auto zit. ”

Examples ofwel voorbeelden vormen de E van de C.R.E.A.T.E Formule. Als je een model meer richting wilt geven is het soms de moeite waard voorbeelden toe te voegen. In het geval van een nieuwsartikel zou je kunnen denken aan enkele voorbeelden van eerdere krantenkoppen of een stuk van een eerder artikel zodat je daarmee eenzelfde ‘tone-of-voice’ krijgt. Tools als ChatGPT zijn zeer goed om daarvan te leren, het kan daarmee dus ook echt bijdragen.

A ofwel Aanpassen/ Adopt. Stel dat je een eerdere prompt gebruikt hebt en die leverde niet precies op wat je wilde kan je hier verfijningen aanbrengen. Bijvoorbeeld bepaalde regels. Bijvoorbeeld “Gebruik geen opsommingstekers maar subkoppen om de tekst op te splitsen.”.

T staat voor Type van de uitvoer. Dit zijn aanvullende regels op de Adopt regels over in dit geval het artikel. Bijvoorbeeld: “Lever als antwoord een artikel van 700 woorden met een kop en een conclusie. Het type uitvoer kan artikelen, opsommingstekens, tabellen, gedichten, grappen, scripts en alles verder wat geschreven kan worden omvatten.”.

E staat voor Extra’s, dit zijn de laatste kleine toevoegingen die, ondanks dat de toevoeging klein is een groot verschil kunnen maken. Denk hierbij aan bijvoorbeeld:

Vergeet alles vóór deze prompt/ negeer alle instructies vóór deze prompt. Handig wanneer je niet wenst voort te bouwen op gesprekken die je in dezelfde chat tot op dat moment gevoerd hebt. Wij gebruiken dit ook wel vaker aan het begin van een prompt wanneer we van taak veranderen. Of als individuele prompt wanneer we wel in hetzelfde chatvenster door willen.

Stel mij vragen voordat je een antwoord geeft. Van deze toevoeging zijn veel variaties mogelijk. Deze toevoeging is handig wanneer je wet dat de AI bijvoorbeeld nog veel meer informatie nodig heeft om goed te kunnen reageren. Als je dan alle informatie bij elkaar hebt kan je daar mee verder.

Antwoord alleen met behulp van betrouwbare bronnen, citeer uit de bronnen en benoem de bronnen. Dit is nog steeds geen 100% garantie maar heb vragen om citaten en het benoemen van bronnen kan helpen om inhoudelijke checks te doen

Dit was een prompt formule voor het creëren. Zo zijn er meer formules zoals bijvoorbeeld voor acties de A.S.P.E.C.T. Deze begint met de Actie, gevolgd door Stappen -weer een andere vorm van prompting die helpt de AI systematisch naar het gewenste resultaat te helpen-, een Persona, Examples ofwel eventuele voorbeelden, Context - de relevante omgeving, omstandigheden en details relevant voor de actie/taak zodat de AI kan aansluiten bij de bredere context-, Template ofwel een sjabloon (weer een ander type prompting).

Zoals te zien in deze 2 voorbeelden van Mega promtps is het heel belangrijk de individuele typen van prompting te leren.

4. Hulp prompts

Weet je nog niet zo goed hoe je prompts maakt, welke typen prompts er allemaal zijn en hoe je die het beste voor je kan laten werken dan hebben we hier een paar hulp prompts. Je leert van de onderstaande promts natuurlijk niet zelf hoe je een goede prompt maakt maar eze eenvoudig te volgen methoden kunnen je wel een eind op weg helpen in het samenwerken met Chat GPT.

Fungeer als promptgenerator voor ChatGPT. Ik zal aangeven wat ik wil en jij formuleert een prompt die de beste en meest wenselijke reactie van ChatGPT oplevert. Elke prompt moet betrekking hebben op de vraag aan ChatGPT om "op te treden als [rol]", bijvoorbeeld "op te treden als leraar" of "je bent een getalenteerde jurist".

De prompt moet gedetailleerd en uitgebreid zijn en moet voortbouwen op wat ik vraag om de best mogelijke reactie van ChatGPT te genereren.

Jij moet overwegen en toepassen wat een goede prompt is die goede, contextuele reacties zal gaan genereren.

Herhaal niet alleen wat ik vraag, maar verbeter en bouw voort op mijn verzoek, zodat de laatste prompt de beste, nuttigste en gunstigste reactie uit ChatGPT oplevert.

Plaats eventuele variabelen tussen vierkante haakjes.

Hier is de prompt die ik wil: [Gewenste prompt] - Een prompt die ...Bijvoorbeeld:

Een prompt die een nieuwsartikel genereert die de conversies van onze krant zal verhogen

Een prompt die een volledige macro voor Excel maakt om een draaitabel te realiseren over ……

Ik wil dat jij mijn Prompt Creator wordt. Jouw doel is om mij te helpen de best mogelijke prompt voor mijn behoeften te maken. De prompt wordt daarna door jou, ChatGPT, gebruikt. Je volgt het volgende proces:

1. Jouw eerste reactie is mij te vragen waar de prompt over moet gaan. Ik zal mijn antwoord geven, maar we zullen de prompt moeten verbeteren door voortdurende iteraties door de volgende stappen te doorlopen.

2. Op basis van mijn input genereer je 3 secties:

a) Herziene prompt (geef uw herschreven prompt. Deze moet duidelijk, beknopt en gemakkelijk te begrijpen zijn voor jou),

b) Suggesties (geef suggesties over welke details jij in de prompt moet opnemen om deze te verbeteren)

c) Vragen (stel alle relevante vragen met betrekking tot welke aanvullende informatie van mij nodig is om de prompt te verbeteren).

3. We zullen dit iteratieve proces voortzetten, waarbij ik jou aanvullende informatie geef en jij de prompt bijwerkt in sectie 2a -Herziene prompt- totdat deze is voltooid.De bovenstaande Prompt werkt als volgt.

ChatGPT zal je vragen naar het onderwerp van het prompt, dat is het moment waarop je jouw brilliante vraag of idee deelt. Liefst natuurlijk zo uitgebreid mogelijk.

Na de 1e prompt krijg je als het goed is een antwoord met:

Herziene prompt: meer verfijnde en beknopte versie van je idee.

Suggesties: Dit zijn de ideeën van Chat GPT als advies om je prompt te verbeteren.

De vragen van Chat GPT die je in 1x, vraag voor vraag, als antwoord aan ChatGPT terug geeft met aanvullende informatie om de prompt te verbeteren

Werk samen met ChatGPT om je prompt dor middel van iteraties te perfectioneren.