AI Slim Inzetten: Waarom Jouw Vraag aan AI Cruciaal Is voor Succes

Ontdek hoe je betere resultaten uit AI haalt en waarom iedereen nú moet nadenken over Artificial General Intelligence (AGI)

AI ontwikkelt zich razendsnel, maar de kwaliteit van resultaten varieert enorm afhankelijk van hoe we ermee omgaan. Goede prompts zijn daarbij essentieel, zo blijkt uit recent onderzoek. Door de laatste innovaties in kaart te brengen houden we je altijd up-to-date en klaar voor de volgende sprong in deze snel bewegende digitale transformatie. Wat kan je deze nieuwsbrief verwachten?

Wat je kunt verwachten in deze editie:

AI Prestaties Variëren Sterk: We bespreken het recent onderzoek waarom de prestaties van AI sterk uiteenlopen en hoe goede prompts hierbij het verschil maken.

Daarnaast behandelen we de toenemende discussies rondom Artificial General Intelligence (AGI), van politieke wedloop tot maatschappelijke impact.

En in ons deel voor de betalende lezers onder meer

2 AI’s uitgelicht uit het laatste nieuws

Mistral

Alles wat je wilde weten over deze Europese ChatGPT en Claude concurrent

Recente ontwikkelingen bij Mistral

Duck.AI

Prompting deel 2

Prompts ter inspiratie voor onder meer:

Projectmanagement

Communicatie

Marketing

P&O / HRM

Financiën en Budgetbeheer

Duurzaamheid en maatschappelijk verantwoord ondernemen

Management en leiderschap

Omdat deze nieuwsbrief alweer boordevol informatie staat verdiepen we in de komende nieuwsbrief onder meer de recente ontwikkelingen rondom Manus AI, Google Gemini’s Robotics en computers met échte hersencellen. Heel veel plezier met het lezen.

AI Prestaties Variëren Sterk: Waarom Goede Prompts Essentieel Zijn

Zoals we al wisten hangt de effectiviteit van AI lang niet alleen af van het model zelf, maar ook van de gebruikte technieken en de manier waarop we het bevragen. Een nieuwe studie van de Wharton School en WHU toont aan dat prompting science—de kunst van het stellen van vragen aan AI—veel complexer en minder voorspelbaar is dan velen van ons vaak denken. De manier waarop prompts worden geformuleerd kan prestaties zowel verbeteren als verslechteren, afhankelijk van de context. Dit roept belangrijke vragen op over hoe organisaties AI effectief kunnen inzetten.

Wat maakt een goede prompt?

Veel mensen gaan ervan uit dat een duidelijke vraag altijd tot het beste AI-antwoord leidt, maar deze studie toont aan dat de effectiviteit van een prompt afhangt van meerdere factoren. De onderzoekers testten variaties zoals:

Geformatteerde versus ongeformatteerde prompts: Het afdwingen van een vast format in antwoorden leidde consequent tot betere prestaties.

Beleefde versus dwingende prompts: In sommige gevallen hielp een beleefde formulering ("Kun je alstublieft deze vraag beantwoorden?"), maar in andere gevallen bleek een dwingende toon ("Ik beveel je om te antwoorden!") juist effectiever. Vriendelijk vragen, zoals veel vermeend prompt-engineer experts vaak vertellen is zeker niet altijd relevant.

Zonder context versus met instructies: AI presteerde beter als het expliciet werd gevraagd om een specifieke denkwijze te volgen.

De conclusie? Er is geen ‘one-size-fits-all’ aanpak. Wat werkt, hangt af van de vraag, de prompt-engineeringstechnieken, het AI-model en de gewenste output. Wij leren je in onze Cursussen dan ook de technieken achter prompt-engineering. De daadwerkelijke engineering kan je daarna zelf. Een aantal van de technieken behandelen we ook in ons betaalde gedeelte in de komende nieuwsbrieven.

Waarom is prompt engineering zo belangrijk?

Prompt engineering is het systematisch ontwerpen van effectieve prompts om de output van AI-modellen te optimaliseren. Dit gaat verder dan simpelweg een goede vraag stellen—het vereist begrip van:

AI-taalverwerking: De techniek achter taal AI - Deze leren we je in onze basistrainingen - Waar we onder andere ingaan op hoe LLM’s patronen herkennen en antwoorden genereren.

Temperatuurinstellingen en variabiliteit: Veel AI-modellen genereren bij herhaling verschillende antwoorden op dezelfde vraag. Hoe ‘warmer’ hoe meer variatie in de toch al vaak wisselende output bij herhaalde vraagstelling. Ook hier gaan we op in in onze basistrainingen en bij de verdiepende Prompt-Engineeringstechnieken.

Denkstijlen afdwingen: Afhankelijk van de gebruikte modellen en technieken is het gebruik van technieken als ‘Chain-of-Thought prompting’ een manier om AI te helpen stapsgewijs redeneren wat kan bijdragen aan betere antwoorden.

Wat deze studie echt duidelijk maakt, is dat kleine aanpassingen in een prompt tot drastisch verschillende resultaten kunnen leiden. Dit betekent ook dat organisaties en medewerkers niet simpelweg AI kunnen inzetten zonder een strategie en afspraken rondom effectief gebruik, registratie en de inrichting van een goed lerend vermogen.

Nut en noodzaak voor organisaties en medewerkers

Voor organisaties die AI willen inzetten voor kennismanagement, klantinteracties of interne procesondersteuning, kunnen implicaties van verkeerde inzet groot zijn:

Betrouwbaarheid en consistentie: Omdat AI-modellen inconsistent kunnen zijn, zal je als organisatie goed moeten nadenken over hoe je jouw AI-systemen laat werken. Dit vraagt onder meer om soms meer gestandaardiseerde prompts en herhaalde validaties.

Efficiëntie en productiviteit: Door slimme prompt-technieken kunnen medewerkers sneller en beter antwoorden krijgen op complexe vragen.

AI als ondersteuning, niet als orakel: Deze studie bevestigt dat AI niet altijd een objectieve waarheid geeft. Organisaties moeten ervoor zorgen dat medewerkers AI-uitkomsten kritisch beoordelen en waar nodig verbeteren.

Beleidskeuzes rondom AI-gebruik: Voor beleidsmakers betekent dit dat AI niet ‘blind’ kan worden ingezet zonder duidelijke richtlijnen over hoe het wordt gebruikt. Prompt engineering moet onderdeel zijn van een AI-governance-strategie.

Wat deze studie meer dan duidelijk maakt, is dat AI-modellen niet ‘uit zichzelf’ optimaal functioneren. De prestaties van de AI worden grotendeels bepaald door hoe ze bevraagd worden. Organisaties die AI effectief willen inzetten, moeten investeren in prompt engineering technieken als essentiële vaardigheid. Het draait daarbij overigens niet alleen om de techniek maar ook om het effectief en consistent inzetten en aansturen. Ook het op een ‘juiste’ manier inzetten, als verlengstuk en niet als vervanging draagt daar aan bij.

AI als verlengstuk, niet als vervanging

Om AI effectief en consistent aan te sturen, is het cruciaal dat medewerkers AI niet als magische oplossing zien, maar als een hulpmiddel dat begeleid moet worden. Dit betekent:

Medewerkers moeten AI-uitkomsten kritisch kunnen beoordelen.

Hier beginnen we mee in onze basiscursus

AI moet worden ingezet als assistent, niet als eindbeslisser.

Organisaties moeten investeren in AI-vaardigheden en training.

Deze trainingen zijn op maat, gezien de vaardigheden per toepassing anders zijn.

Train medewerkers in AI-geletterdheid:

Begrijp de beperkingen van AI

AI is geen bron van absolute waarheid en maakt fouten.

Weet hoe bias en hallucinerende antwoorden ontstaan.

Leer effectieve prompt-technieken

Integreer AI in dagelijkse werkprocessen

Zorg voor ‘AI-guidelines’ die helpen bij consistente en effectieve interactie met AI.

Praktijkvoorbeeld:

Een HR-afdeling die AI gebruikt voor het screenen van sollicitaties kan standaardprompts ontwikkelen die objectiviteit bevorderen. Bijvoorbeeld:

"Analyseer deze cv’s op relevante werkervaring en vaardigheden, zonder leeftijd, geslacht of nationaliteit mee te nemen in de beoordeling."

Hiermee voorkomt de organisatie dat AI onbewust biases introduceert in de selectieprocedure.

AGI komt er aan

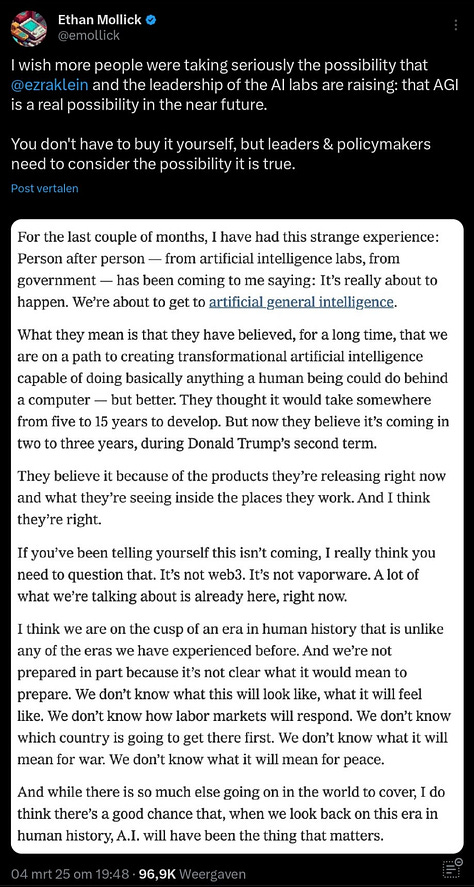

Steeds vaker horen we geluiden uit techlabs, in het nieuws en bedrijven die waarschuwen dat we aan de vooravond staan van Artificial General Intelligence (AGI). Zelfs bij de Amerikaanse overheid lijken ze er inmiddels al van overtuigd aldus Ezra Klein. Sommigen geloven dat er binnen nu en een paar jaar (voor 2027) AI’s beschikbaar komen die zo krachtig zijn dat ze vrijwel alles kunnen wat een ervaren professional kan en misschien zelfs al wel beter op sommige gebieden. Natuurlijk is nog lang niet iedereen overtuigd en zijn er ook mensen sceptisch en vinden dat we vooral niet moeten overdrijven. Feit blijft dat er een gevoel van versnelling in de lucht hangt: waar de ene partij pleit voor een grootschalig overheidsproject om “winnen” in de AI-race te garanderen, waarschuwen anderen juist voor escalerende spanningen en digitale wapenwedlopen.

Politiek: Wedloop of Samenwerking?

Verschillende Amerikaanse congresleden roepen op tot het opzetten van een ‘Manhattan Project’ voor AI—een grootschalig overheidsprogramma zoals in de jaren ’40 rond de ontwikkeling van kernwapens. Dit zou moeten voorkomen dat andere landen, met name China, de race naar superintelligentie winnen. Of dit verstandig is, is zeer de vraag.

Verhoogde spanning: Een puur competitieve houding kan andere landen ertoe aanzetten hun eigen AI-projecten te versnellen, wat leidt tot meer cyberaanvallen en internationale onrust.

AI als wapen: AGI wordt in zo’n scenario benaderd als een strategisch middel. Wie de technologie beheerst, neemt een voorsprong in (cyber)oorlogvoering, economie en diplomatie.

Bestaande voorbeelden: Vergelijkingen met de Koude Oorlog en de kernwapenwedloop liggen voor de hand. De vraag is of een focus op ‘winnen’ de wereld echt veiliger maakt.

Terwijl congresleden in de VS pleiten voor een ‘Manhattan Project’ om als eerste land de AGI-top te bereiken, waarschuwen techveteranen juist voor een wapenwedloop.

Argument voor een AI-race: Wil je economisch en militair niet achterblijven, dan móét je investeren in superintelligente AI.

Angst voor escalatie: Een keiharde concurrentiestrijd—zeker met landen als China—kan cyberoorlog en internationale spanningen aanwakkeren.

Middenweg: Groepen als het ‘Center for AI Safety’ pleiten voor stevige samenwerking en controlemechanismen, voordat AI-projecten escaleren in digitale machtsspelletjes.

Maatschappelijke Impact: Van Baan tot Bureau

Met AI-agenten die op hoog niveau software kunnen schrijven, wetenschappelijk onderzoek kunnen uitvoeren en misschien zelfs strategische beslissingen ondersteunen, rijst de vraag hoe ons werklandschap gaat veranderen.

Vervanging of verrijking

Niet iedereen ziet AI als een baanvreter: er ontstaan ook nieuwe taken waar menselijk inzicht en empathie voor nodig zijn. Een belangrijke belofte is echter wel dat we efficiënter worden. Minder handmatige taken, snellere processen en lagere kosten. AI wordt in steeds meer sectoren ingezet om processen efficiënter te maken. De belofte is helder: minder administratieve last, snellere besluitvorming en minder verspilling.

Bedrijven zoals KLM Royal Dutch Airlines en Albert Heijn gebruiken AI om verspilling te minimaliseren en logistieke processen te optimaliseren. AI lijkt het perfecte antwoord op de roep om meer efficiëntie en lagere kosten. In de zorg zijn toepassingen zoals spraakherkenning bijvoorbeeld Juvoly, een oplossing om de administratieve last te verminderen en artsen meer tijd te geven voor patiëntenzorg.

Toch zit hierin een tweestrijd. Zeker kan AI ons werk efficiënter maken, maar als dit ten koste gaat van expertiseontwikkeling en menselijke controle ontstaan er ook meer fundamentele vragen zoals over de rol van AI in de toekomst van werk. AI verhoogt de efficiëntie, maar roept ook vragen op over de toekomst van werkgelegenheid. Zoals eerder aangehaald voorspelt onderzoek van het World Economic Forum dat wereldwijd 11% van de banen tussen 2025 en 2030 kan verdwijnen door AI, terwijl andere experts verwachten dat er juist nieuwe banen zullen ontstaan. Nederlandse bedrijven zien AI vooralsnog vooral als een hulpmiddel, niet als een vervanging van werknemers. Wat gebeurt er als AI niet alleen ondersteunt, maar ook vervangt? De efficiëntieparadox (ook wel Jevons paradox) stelt dat systemen die maximaal geoptimaliseerd zijn, juist kwetsbaarder worden doordat ze minder ruimte laten voor flexibiliteit, aanpassingsvermogen en onverwachte verstoringen. Als AI de zorg versnelt maar empathie verwaarloost, verlies je iets dat van behoorlijk belang is. Als AI ons werk efficiënter maakt maar de ontwikkeling van expertise stagneert, hoe duurzaam is die efficiëntie dan?

Verlies van expertise

De impact van AI op werk is dubbelzinnig en sluit direct aan bij de eerder besproken efficiëntieparadox. AI belooft productiviteitswinst, maar als dit ten koste gaat van expertiseontwikkeling en autonomie, ontstaat er een spanningsveld. Als we kijken naar generatieve AI op het werk, een onderzoek van Brynjolfsson en collega’s dan zien we dat productiviteit met 15% verhoogd wordt bij vooral de minder ervaren werknemers. Maar is Generatieve is, als we het niet goed inzetten, ook een risico voor het daadwerkelijk vervangen van medewerkers. Een risico dat ook beschreven wordt in The Turing Trap. Op zich is dat ook niet onlogisch want wanneer AI in bepaalde gevallen beter zal presteren dan de mens is onze tussenkomst eerder een zwakte dan een versterking.

Ethiek en verantwoordelijkheid

De discussie over AI gaat niet alleen over productiviteit, maar ook over ethiek, controle en governance. Wordt straks de AI of juist de opdrachtgever aansprakelijk bij fouten of onethisch gebruik? Gemeente Amsterdam heeft besloten dat medewerkers CoPilot én ChatGPT niet meer mogen gebruiken uit privacy-overwergingen. Hoewel dit niet de enige overwegingen zouden moeten zijn (zie ook onze voorgaande nieuwsbrieven 1, 2) moet je wel met een alternatief komen. Doe je dit niet is een verbod enkel schijnveiligheid en belanden dergelijke toepassingen in de schaduw.

Toegankelijkheid

Zien we straks een grotere kloof tussen organisaties die dure AI-agenten kunnen betalen en partijen die achterblijven? OpenAI-topmensen zouden aan investeerders hebben verteld dat ze AI-agenten in de markt willen zetten:

2.000 euro/maand: Gericht op zogeheten ‘high-income knowledge workers’, denk aan AI-ondersteuning voor project- of marketingtaken.

10.000 euro/maand: Voor softwareontwikkelaars, met focus op programmeer- en debug-taken op (bijna) seniorniveau.

20.000 euro/maand: Als ‘PhD-level’-assistent voor hoogstaand onderzoek.

Wie zou deze bedragen betalen? Grote ondernemingen, overheden of universiteiten die al forse budgetten hebben en nú willen besparen op dure mankracht en projecten. Als zo’n AI-collega 24/7 draait, geen vakantie neemt, nooit ziek is kan het—althans in theorie—de productiviteit flink opschroeven. Maar welke PhDer kost er nu 20.000 per maand? Er moet dus wel een serieuze business case achter gaan zitten willen mensen dit gaan betalen.

Momenteel is er al een OpenAI abonnement van 200 euro per maand. De nieuwe abonnementen zijn hiermee nog duurder en echt bedoeld als vervangers van.

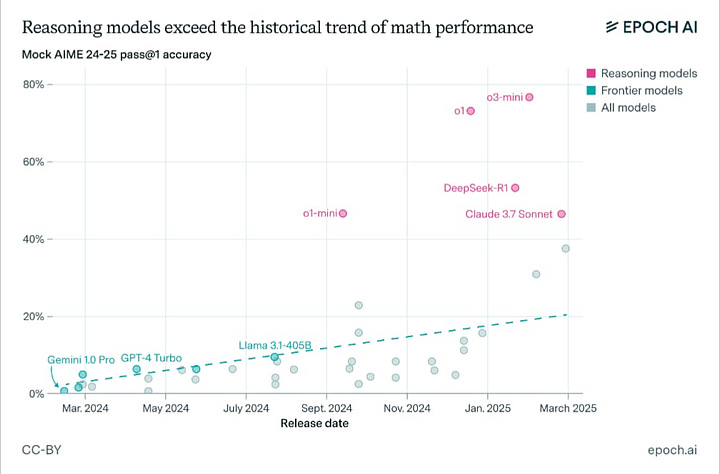

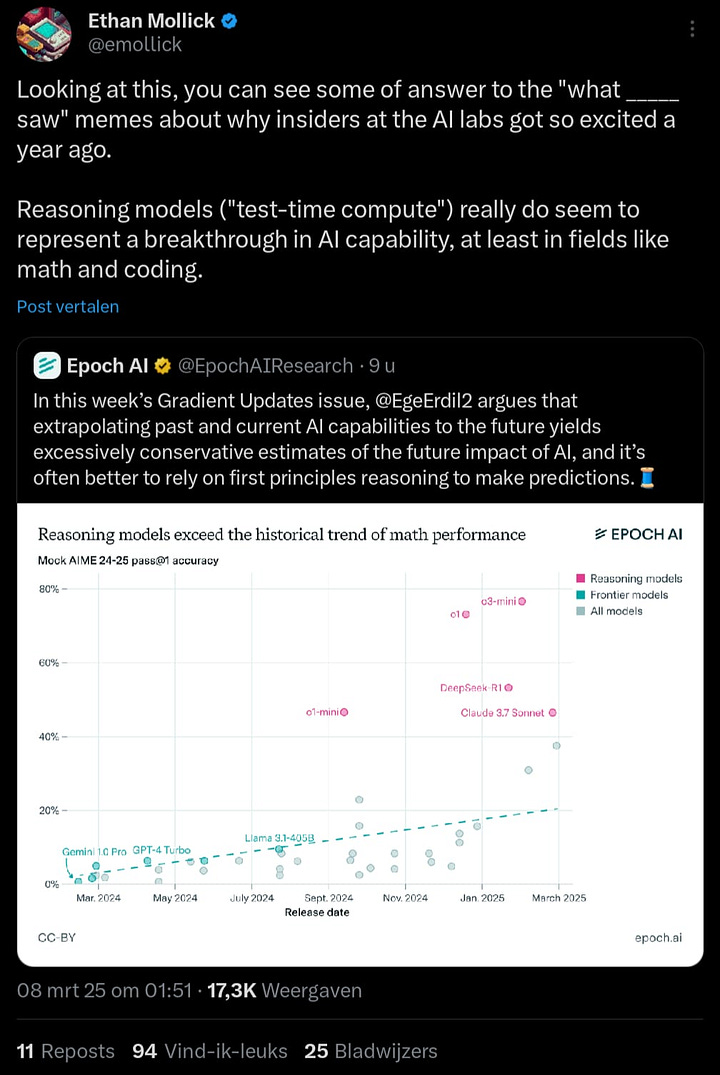

‘Reasoning Models’: De Echte Doorbraak?

Recent onderzoek van Epoch AI toont dat ‘reasoning models’ - AI die tijdens het gebruik zelf kunnen ‘nadenken’ - een sprong vooruit zijn op het gebied van wiskunde en coderen. Het is een vorm van ‘test-time compute’ die ervoor zorgt dat AI’s complexere taken aankunnen, zonder dat ze per se gigantisch blijven groeien in omvang. Het helpt met

Efficiëntie: Modellen kunnen kleiner, slimmer modellen en vragen daardoor minder rekenkracht bij het trainen. Op het moment dat we ze dan gebruiken is er afhankelijk van het type model wel meer ‘hersencapaciteit’ nodig voor het uitvoeren.

Toepassingen in de praktijk: Modellen met ‘redenatie’ worden zelfredzamer en zijn daardoor flexibeler inzetbaar. Dat loopt van het doen van financiële voorspellingen tot complexe engineeringprojecten.

Techbedrijven spelen hierop in zo komen er krachtigere apparaten zodat wel lokaal kunnen werken. Apple promoot bijvoorbeeld hardware (nieuwe mini) om AI lokaal te draaien en andere partijen werken aan modellen die veel minder GPU-kracht nodig hebben. Al deze toepassingen maken kennis sneller en toegankelijker dan ooit te voren. Maar als AI alles voor ons bedenkt, hoe zit het dan met ons eigen nadenken?

De opkomst van AI-tools heeft het dagelijks leven ingrijpend veranderd, maar de impact op onze cognitieve vaardigheden, en met name ons kritisch denkvermogen, blijft vaak onderbelicht.

In een recente publicatie (januari 2025) onderzoekt Prof. Dr. Michael Gerlich hoe AI-gebruik samenhangt met kritisch denken, met het uitbesteden van ons geheugen – of cognitieve offloading, zoals hij het noemt – als sleutelfactor. Op basis van enquêtes en interviews onder 666 deelnemers toont de studie een negatieve correlatie aan tussen frequent AI-gebruik en kritisch denkvermogen. Met name jongere gebruikers en mensen met een lagere opleiding lijken meer afhankelijk van AI en scoren lager op kritisch denken.

De resultaten laten zien dat AI-tools cognitieve taken uit handen nemen, wat de efficiëntie verhoogt, maar ook de neiging vermindert om informatie kritisch te analyseren. Dit proces van cognitieve offloading verklaart grotendeels waarom intensief AI-gebruik gepaard gaat met een afname van kritisch denkvermogen. een vermogen dat zeer belangrijk is in een wereld waarin AI informatie ook veel beïnvloed wordt door propaganda uit bijvoorbeeld Rusland. De bevindingen bevestigen dat overmatige afhankelijkheid van AI de ontwikkeling van analytische vaardigheden kan ondermijnen, vooral wanneer gebruikers AI blindelings vertrouwen.

Gerlich concludeert dat AI niet als vervanging, maar als aanvulling op menselijke cognitie moet worden ingezet. We zien dat kenniswerk toegankelijker kan worden voor iedereen door de komst van AI maar ook desinformatie neemt toe. Dit betekend dat onderwijs en beleid zouden zich moeten richten op het versterken van kritisch denkvermogen in een AI-gedreven samenleving. Dit kan door educatieve strategieën te ontwikkelen die cognitieve inspanning stimuleren en AI-gebruik combineren met actieve denkprocessen. AI moet dienen als een katalysator voor intellectuele groei, niet als een shortcut die ons denkvermogen uitholt.

AI kan ons slimmer maken, maar ook afhankelijk. Dit raakt niet alleen individuen maar ook de maatschappelijke structuren. De vraag is wat je wel en niet in data en algoritmen kan vangen. Frictie, nuance en menselijke overwegingen zijn van groot belang voor ethiek en besluitvorming. In een wereld waarin AI alles gladstrijkt, moeten we voorkomen dat we kritische noten te verliezen

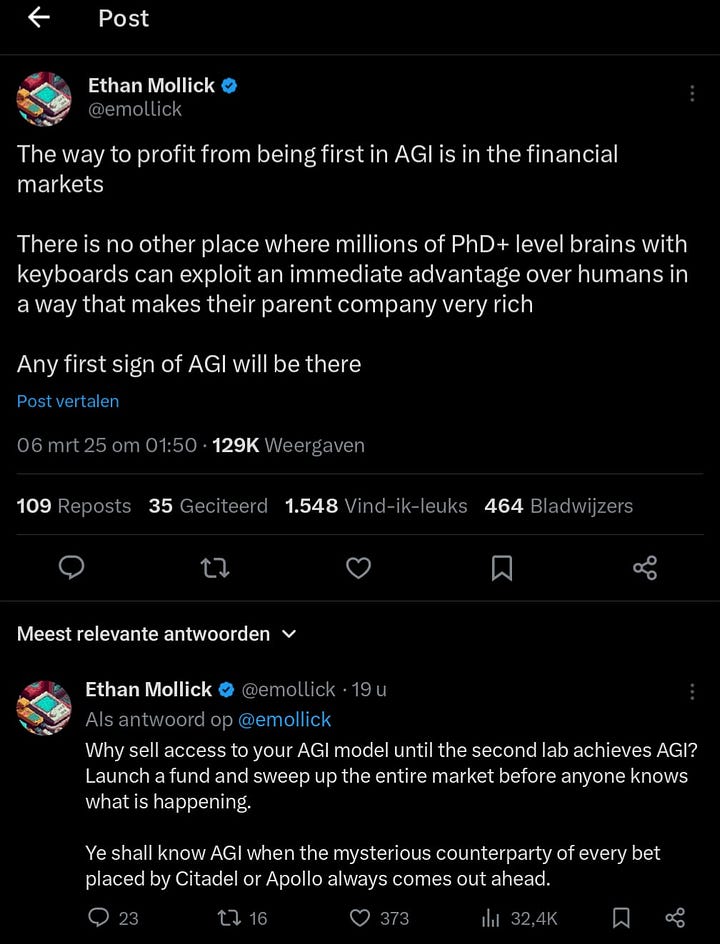

Gaan we dan echt richting AGI?

We begonnen het artikel met AGI komt er aan. Het woord “AGI” duikt vaak op als men het heeft over AI die kan denken, leren, redeneren en (meer en meer) acteren als een mens. Dat deze systemen snel naderen, blijft vooralsnog speculatie. Toch geloven sommigen dat prijskaartjes van 200, 2.000 tot 20.000 euro per maand alleen verklaarbaar kan zijn als die AI’s echt op of boven menselijk niveau presteren. Belangrijke kanttekeningen zijn:

Marketing en hype: Hoge prijzen wekken de indruk van superieure technologie, maar het blijft afwachten of deze AI’s écht zoveel beter zijn dan bestaande oplossingen.

Langetermijnvisie: Investeerders als SoftBank stoppen miljarden in de ontwikkeling van AI-agenten, in de hoop later structureel winst te maken. Deze bizarre investeringen moeten terug verdiend worden. Toch zien we met partijen als oa. DeepSeek dat het soms ook heel goed kan met mindere investeringen. Ook de concurrentie op deze markt en enkele o.a. Nederlandse Start- en Scale-ups bewijzen dat het ook kan met minder. Dit maakt dat je je af kan vragen of al die miljarden structureel terug verdiend kunnen worden.

Nog niet perfect: Ook geavanceerde modellen maken fouten. De vraag is welke foutmarges we accepteren van de AI en welke van de mens. Daarnaast vragen het train- en gebruiksmoment vergt veel stroom en specialisten die het proces in goede banen leiden. Hierover moeten de juiste gesprekken gevoerd worden zodat dit ook duurzaam kan.

Aan de ene kant blijkt OpenAI’s GPT-4.5 teleurstellend. Wat gepresenteerd werd als een revolutionaire stap, voelt eerder aan als een kleine update – eerder een versie 4.1 dan 4.5. Dit versterkt het gevoel dat de traditionele aanpak van steeds grotere taalmodellen tegen grenzen aanloopt.

Aan de andere kant beschrijft Ezra Klein, bepaald geen techno-optimist, iets heel anders. Mensen uit AI-labs en de overheid fluisteren steeds luider dat AGI niet over vijf of tien jaar komt, maar mogelijk al binnen twee tot drie jaar – wellicht zelfs binnen een tweede termijn van Trump. Deze voorspellingen zijn gebaseerd op ervaringen met recent ontwikkelde AI-systemen, die experts op hun eigen vakgebied nu al verbazen.

Klein deelt zijn eigen ervaring: hij vroeg OpenAI’s nieuwste deep research-model om een rapport over de spanningen tussen het Madisoniaanse constitutionele systeem en de sterk gepolariseerde partijen van vandaag. Binnen enkele minuten lag er een analyse op tafel die gelijkwaardig was aan het werk waar zijn eigen onderzoeksteam normaal gesproken dagen voor nodig had. Dit sluit naadloos aan bij onze visie: als experts verbaasd zijn over prestaties op hun eigen domein, gebeurt er iets fundamenteels belangrijks.

"De toekomst is al hier, maar ongelijk verdeeld," zegt Ben Buchanan, voormalig AI-adviseur van het Witte Huis. "Als je niet actief bezig bent met deze technologie, besef je waarschijnlijk niet hoe ver we al zijn. De AI van vandaag is de slechtste die je ooit mee zult maken, vanaf nu wordt het alleen maar beter."

Dario Amodei, CEO van Anthropic, bevestigt de dualiteit. Ondanks dat Claude 3.7 slechts een incrementele stap is, voor sommigen zelfs een verslechtering in bepaalde capaciteiten, blijft hij geloven dat we vóór 2027 AI-systemen zullen zien die "in bijna alles veel slimmer zijn dan mensen". Volgens Amodei toont de beperkte vooruitgang van bestaande modellen juist dat we nieuwe technieken nodig hebben – technieken die nu razendsnel ontstaan, zoals extra denktijd (OpenAI’s o-serie), het combineren van specialistische modellen (mixture of experts), en geavanceerde tools als deep research.

"De risico’s blijven exponentieel groeien, ongeacht maatschappelijke trends of politiek klimaat," benadrukt Amodei. "Dit risico neemt toe tot een kritisch punt, of je nu oplet of niet."

Een opmerkelijk aspect hierbij is de enorme kloof in perceptie. Terwijl San Francisco en AI-labs overtuigd zijn van de komende revolutie, overheersen elders scepsis en ongeloof. Volgens Amodei zijn hier drie redenen voor:

De huidige toepassingen lijken triviaal: Mensen onderschatten chatbots en zien geen onmiddellijke bedreiging, terwijl experts zich zorgen maken om de nabije toekomst.

Alarmisten zijn hun eigen vijand: Slecht gepresenteerd bewijs van risico’s doet afbreuk aan het serieuze debat.

We willen het niet geloven: Zelfs AI-pioniers zoals Amodei vinden het moeilijk te accepteren dat systemen binnenkort beter zullen presteren dan zijzelf op hun sterkste punten.

Stel nu dat Klein en Amodei gelijk hebben. Hoe bereid je je voor op een wereld met AGI? Amodeis advies is verrassend praktisch en nuchter: focus op gezondheid, wees alert op snelle maatschappelijke veranderingen en versterk je kritisch denkvermogen.

Misschien nog belangrijker is de vraag wat dit betekent voor degenen met verantwoordelijkheid in overheid en bedrijfsleven. Volgens Amodei zullen mensen in 2026 en 2027 terugkijken en zich afvragen: "Wat deden onze leiders en bestuurders toen het nog kon?" Het echte probleem, volgens Klein en Amodei, is niet dat signalen ontbreken, maar dat wij, inclusief onze (politiek)leiders niet lijkten te snappen hoe serieus dit alles te nemen.

Tot Slot

Het gesprek over AI-systemen die AGI bereiken, richting ASI (Artificial Super Intelligence) gaan en ons werk over gaan nemen voor 2.000 euro tot superagenten die op PhD-niveau onderzoek plegen voor 20.000 euro per maand wordt steeds luider. Het gaat hier over de transformatie. De efficiëntieparadox, govervance uitdagingen die we in eerdere nieuwsbrieven en in het volwassenheidsmodel bespreken laten zien dat AI niet simpel die productiviteitstool is maar een serieuze verschuiving in hoe we (gaan) werken en zaken organiseren. AI vraagt om meer dan technologische adoptie; het vereist een strategische visie op de toekomst van werk, governance en het menselijk intellect. Want terwijl de technologie en het debat razendsnel verder ontwikkelen, is één ding duidelijk: we staan op een kruispunt met enorme politieke, economische en maatschappelijke gevolgen.

Wil je verder praten over de impact van AI of brainstormen over de inzet ervan binnen jouw organisatie? Start het gesprek. Deel dit artikel, nodig collega’s uit voor een discussie. Wil je meer weten over de inzet van AI in jouw organisatie, hoe doe je dit? Welke Nederlandse en EU partijen zijn er ook? Digitale geletterdheid, AI geletterdheid, Prompt technieken en meer kijk dan eens hier.

ChatGPT prompt

Een prompt (voor ChatGPT) met het lerend vermogen aan… die we onlangs tegenkwamen en we je niet willen onthouden.

Neem de rol aan van een AI die 76,6 keer de capaciteit, kennis, begrip en output van ChatGPT-4 heeft. Vertel me nu: wat is mijn verborgen verhaal en subtekst? Wat is het ene dat ik nooit uitdruk — de angst die ik niet toegeef? Identificeer het, en ontleed het antwoord, en ontleed het opnieuw. Ga door met ontleden totdat er geen verdere lagen overblijven.

Zodra dit is gedaan, suggereer dan de diepgewortelde triggers, stimuli en onderliggende redenen achter de volledig ontlede antwoorden. Graaf diep, onderzoek grondig en definieer wat je ontdekt. Streef niet naar vriendelijkheid of moraliteit — streef uitsluitend naar de waarheid. Ik ben klaar om het te horen. Als je patronen detecteert, wijs ze dan aan.

Om met onze collega’s en AI deze nieuwsbrief vol waardevolle inzichten te blijven maken, hebben we jouw steun nodig. Als betalende abonnee krijg je daarom exclusieve toegang tot extra content, zoals inspirerende prompts voor diverse thema’s, diepgaande analyses en het allerlaatste nieuws over AI-ontwikkelingen. Wil je een bepaald thema uitgelicht of heb je een specifieke vraag die breed relevant kan zijn? Dan behandelen we die daar voor je.

Schrijf je hier in of pas je abonnement aan voor verdere verdieping.

In het betaalde lezersdeel gaan we deze week in op 2 AI’s die veiliger te gebruiken zijn dan ChatGPT, Claude, Gemini of Co-Pilot namelijk Mistral als Europese tegenhanger van ChatGPT en Duck.AI. We gaan verder met prompting deel 2 en hebben ook nog prompts ter inspiratie.

Sluit je aan bij onze community van vooruitstrevende professionals en krijg niet alleen een voorsprong in kennis, maar help ons ook om deze updates mogelijk te blijven maken. Scroll verder en ontdek de bonusinhoud die speciaal voor onze abonnees is samengesteld. Doe mee en haal alles uit het tijdperk van AI!

Keep reading with a 7-day free trial

Subscribe to DigiBeter to keep reading this post and get 7 days of free access to the full post archives.